DreamFusion genera modelos 3D a partir de texto. Google Research ha presentado DreamFusion, un nuevo método para generar modelos 3D, esta vez, mediante texto.

El enfoque, que combina un modelo de difusión de texto a imagen 2D con Neural Radiance Fields (NeRF), genera modelos 3D texturizados de una calidad adecuada para su uso en proyectos AR, o como mallas base para esculpir.

Y, lo que es más importante, no requiere un conjunto de modelos 3D reales para usar como datos de entrenamiento, lo que podría allanar el camino para el desarrollo de herramientas prácticas de texto a 3D basadas en IA para el mercado masivo.

Descripciones de texto a modelos texturizados

DreamFusion convierte las descripciones de texto en modelos 3D texturizados. Desarrollado por un equipo de Google Research y UC Berkeley, DreamFusion genera modelos 3D a partir de descripciones de texto como una escultura de metal muy detallada de una ardilla con un kimono tocando el saxofón.

Además de la geometría del modelo 3D, el texto también define sus materiales y texturas, algo que puede probar en la demostración en línea cambiando escultura de metal por tallado en madera o fotografía DSLR.

Combinación de campos de radiación neuronal y difusión 2D. Para generar un modelo, DreamFusion combina dos enfoques clave: campos de radiación neuronal y difusión 2D.

Refina progresivamente un modelo 3D aleatorio inicial para que coincida con las imágenes de referencia 2D que muestran el objeto de destino desde diferentes ángulos: un enfoque utilizado por los modelos de IA existentes como Instant NeRF de Nvidia.

Sin embargo, a diferencia de Instant NeRF, las referencias no son fotos de un objeto real, sino imágenes sintéticas generadas por un modelo 2D de texto a imagen del tipo utilizado por DALL-E 2 de OpenAI y Stable Diffusion de Stability.ai.

Se pueden utilizar modelos 2D de referencia

En este caso, el modelo de difusión 2D es Imagen de Google, pero el resultado general es el mismo: un modelo 3D generado para que coincida con las imágenes de referencia 2D generadas a partir de la descripción del texto original.

Todavía en gran medida es solo una demostración de investigación. En este momento, las oportunidades para jugar con DreamFusion son bastante limitadas.

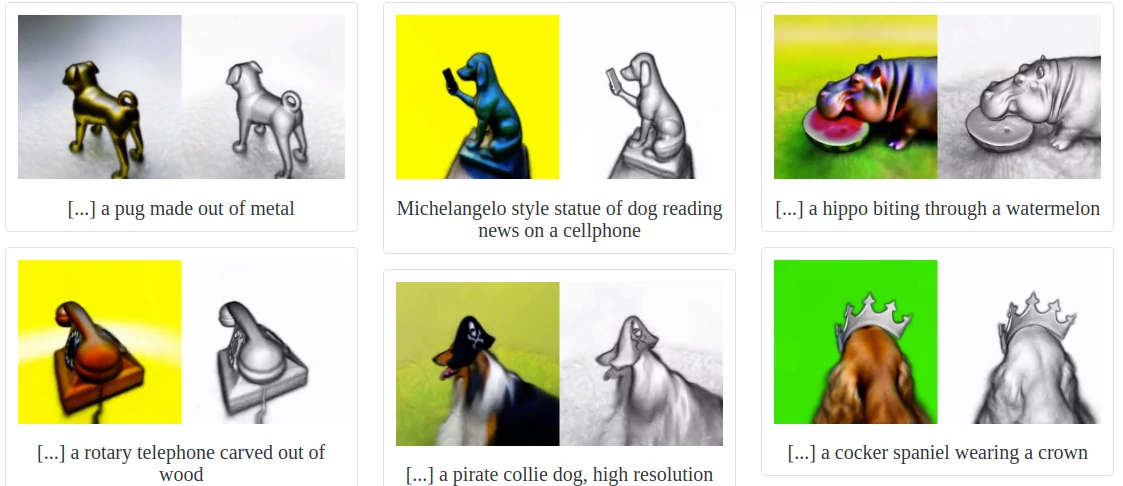

La página de GitHub del proyecto le permite elegir entre una variedad de indicaciones de texto preestablecidas, luego muestra el modelo 3D resultante, pero no le permite ingresar sus propias descripciones de texto.

Los activos en sí también tienen una resolución bastante baja

La galería en línea de DreamFusion muestra una variedad de modelos en formato.glb que parecen adecuados para usar en un proyecto AR, o como mallas base que podrían refinarse manualmente para usar en trabajos de mayor detalle.

¿Está preparando el camino para una nueva generación de herramientas comerciales de texto a 3D? Sin embargo, el significado real de proyectos de investigación como DreamFusion no es lo que pueden hacer actualmente, sino cómo podrían abrir el camino para el desarrollo de herramientas más prácticas.

Mientras que los modelos de difusión 2D como DALL-E 2 se entrenaron con imágenes 2D extraídas de Internet, es mucho más difícil hacer lo mismo con 3D.

Como dice el resumen de DreamFusion: Adaptar este enfoque a la síntesis 3D requeriría conjuntos de datos a gran escala de activos 3D etiquetados y [formas] eficientes de eliminar el ruido de los datos 3D, ninguno de los cuales existe actualmente.

Al eliminar la necesidad de conjuntos de datos 3D a gran escala, DreamFusion plantea la posibilidad de una nueva ola de herramientas de arte generativo de IA, pero para modelos 3D, no imágenes 2D.

Y dado que las herramientas de arte 2D AI como DALL-E tardaron menos de dos años en pasar del anuncio inicial a la disponibilidad pública masiva, podrían estar aquí mucho antes de lo que piensa.

- Puedes leer más sobre DreamFusion en la página de GitHub del proyecto.

- Tienes otros artículos sobre cómo generar imágenes 3D aquí.

- En el foro puedes leer toda la información y los comentarios, sigue leyendo…