El desarrollo de MetaHuman Creator. La aplicación MetaHuman Creator de Epic Games está basada en la nube. Los humanos digitales fotorrealistas fueron una vez, y tal vez todavía lo sean; una de las cosas más difíciles de lograr en efectos visuales y animación. Hoy en día, sin embargo, ahora hay una serie de opciones que permiten tanto a los artistas novatos como a los experimentados «saltar directamente» al ruedo. Creando humanos digitales para proyectos, que van desde modelos increíblemente fotorrealistas hasta versiones más estilizadas pero aún creíbles.

Hoy en día hay una serie de métodos populares y accesibles para crear «avatares» digitales. Que van desde herramientas de creación de contenido digital 3D algo tradicionales; hasta nuevos enfoques en tiempo real, y también aquellos que aprovechan el aprendizaje automático y las técnicas de inteligencia artificial.

El desarrollo de MetaHuman Creator no es trivial

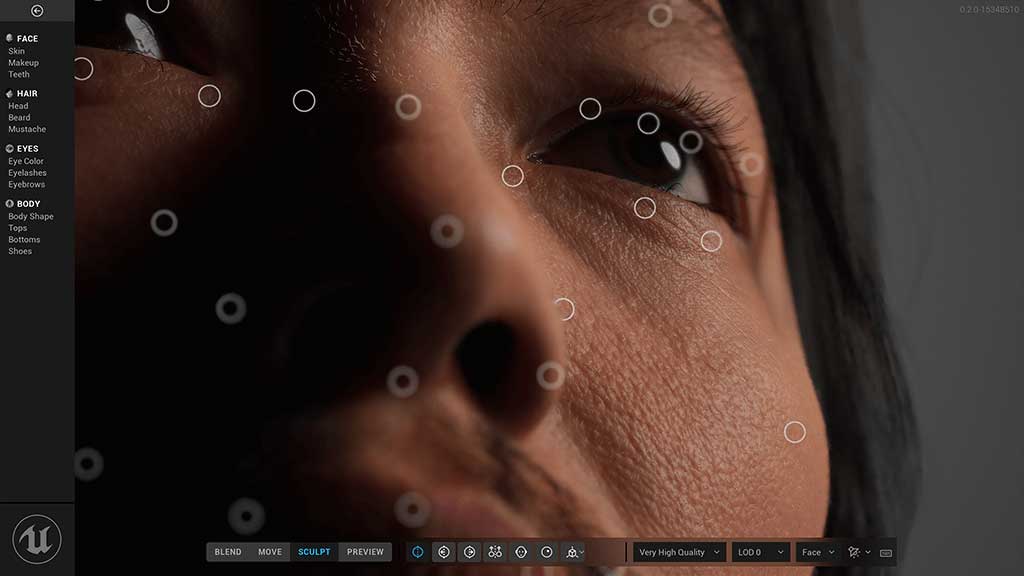

La aplicación MetaHuman Creator basada en la nube de Epic Games se ha convertido rápidamente en una opción para construir humanos digitales. Eso es debido en parte en la explosión de interés y habilidades de las herramientas en tiempo real, en este caso; Unreal Engine de Epic Games, y en parte debido a la velocidad a la que los usuarios pueden generar un humano realista con la aplicación. También ayuda mucho el echo de ser gratis.

Nos enfocamos en democratizar la creación de humanos digitales de alta fidelidad; y el objetivo era tomar una tarea que solo un puñado de expertos en el dominio en el mundo pueden hacer en meses y simplificarla; para que cualquiera pueda crear un humano creíble en minutos. La clave de esto fue la visión de Vladimir Mastilovic y las herramientas y experiencia únicas de su empresa, 3Lateral. Habíamos trabajado con Vlad durante muchos años y decidimos invitarl; a él y a su equipo, a unirse a la familia Epic con este objetivo en mente.

El desafío de desarrollar MetaHuman Creator

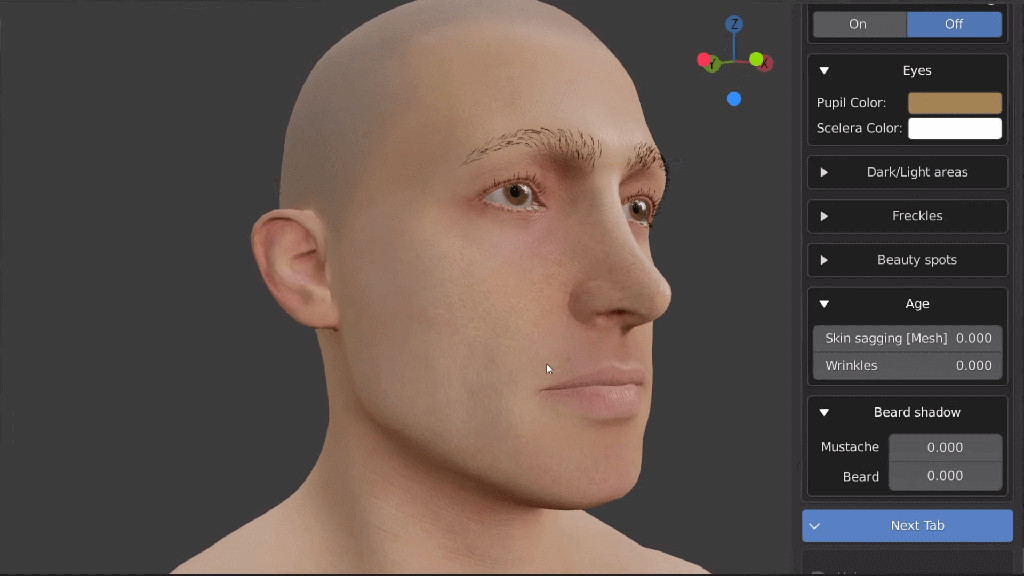

Fue un verdadero desafío desarrollar un sistema que se sienta simple e intuitivo, pero que impulse un back-end que está reconstruyendo una plataforma muy compleja; y tiene todos los detalles necesarios para usar al personaje en un juego o experiencia interactiva, agrega Evans. Fue especialmente difícil crear una interfaz de usuario para la generación de piel humana creíble. Nuestro Shader de piel es uno de los Shaders más complejos que hemos hecho en Epic; y destilarlo a unos pocos controles deslizantes intuitivos fue todo un desafío. Tuvimos que investigar muchas técnicas que involucran el aprendizaje automático y los usos pragmáticos del análisis de componentes principales (PCA); y la separación de frecuencias para llegar allí, pero estamos contentos con los resultados.

Para hacer que MetaHuman sea lo más accesible posible, Evans comenta que Epic inicialmente se concentró en las herramientas de modelado. Sin embargo, relata, «incluso con herramientas de modelado muy intuitivas, todavía se necesitaba conocer la anatomía facial y la construcción para usarlas con éxito. Por ejemplo, si alguien quisiera crear un personaje de ascendencia asiática; necesitaría saber lo suficiente como para tirar hacia abajo del pliegue de la cubierta ocular; creando un monólido como se ve en algunas morfologías faciales asiáticas. Así que agregamos la capacidad de mezclar rasgos específicos de caras de un grupo de personajes existentes. Esto le permite navegar por los ajustes preestablecidos existentes y luego lanzarlos a un espacio de mezcla; y simplemente usar la nariz de uno, al ojo de otro, es mucho más fácil de usar.

Un flujo de trabajo pensado en el desarrollo virtual

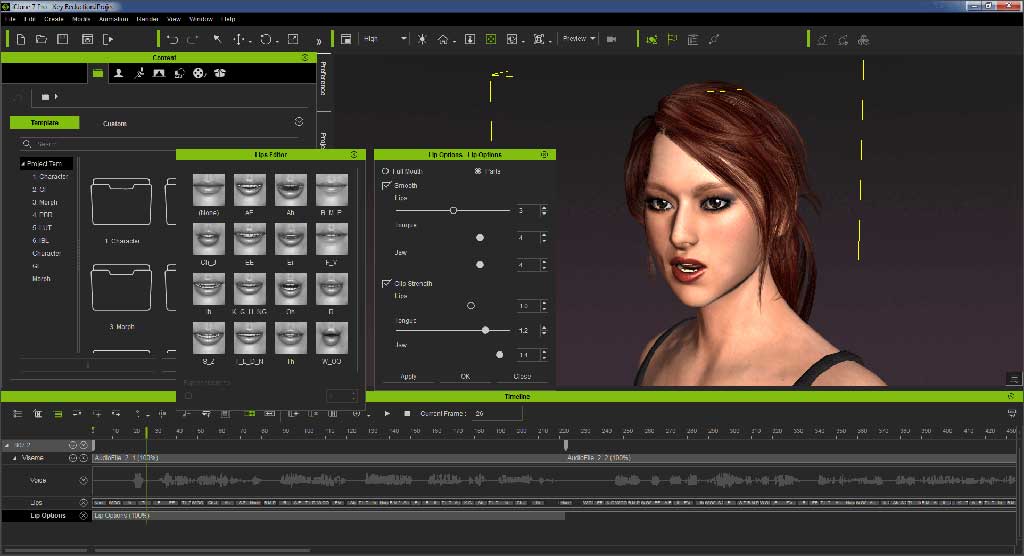

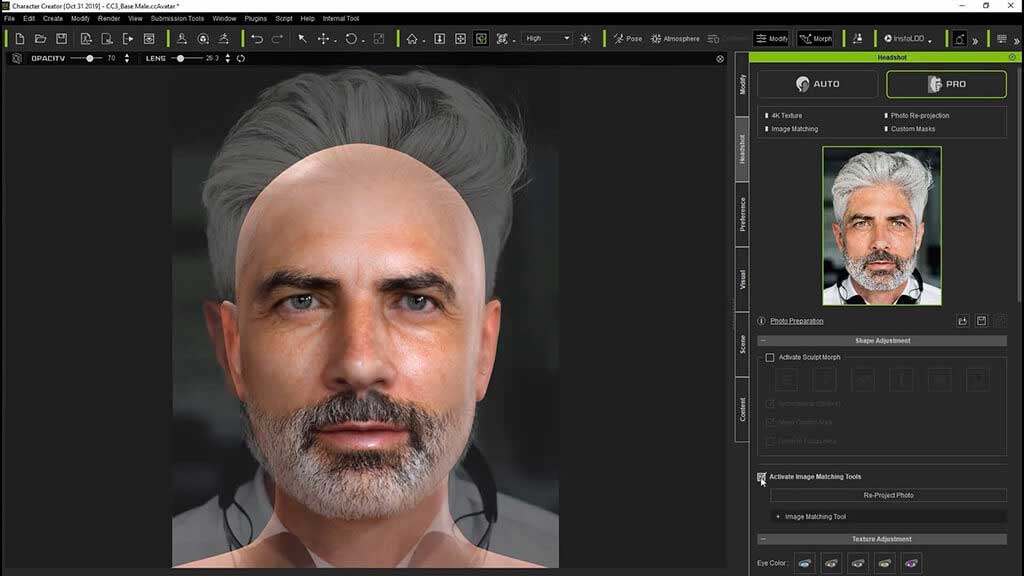

Otra metodología que los artistas han estado adoptando para crear rápidamente humanos digitales creíbles es a través de la canalización de Character Creator (construcción); e iClone (animación) de Reallusion. El software, que también incorpora una serie de características en tiempo real, contiene modelos base que son altamente modificables y totalmente manipulados.

Los humanos digitales hechos con Character Creator pueden asumir el aspecto de cualquier persona o imagen de la función de la herramienta Reallusion HeadShot. Que permite a los usuarios importar una fotografía y generar un modelo de cabeza basado en la persona en la fotografía. El escuadrón suicida de James Gunn utilizó Character Creator e iClone ampliamente; para desarrollar y animar a todos los héroes que aparecen en la película durante 16 escenas de previs, por ejemplo.

También hay herramientas para crear detalles faciales específicos, como las aplicaciones SkinGen; Hair and Beard, con SkinGen que permite aspectos como micro-detalles para poros, manchas y arrugas. Una vez que se diseña un personaje, se puede enviar a iClone para animación o exportar como FBX o USD a muchas plataformas. Incluidas Omniverse y Unreal Engine de Nvidia. Una serie de herramientas, incluidas las en tiempo real, que capitalizan los nuevos enfoques de la sincronización de labios; la marioneta facial, la captura de movimiento y el keyframing pueden dar al movimiento humano digital.

Generando Humanos con MetaHuman Creator

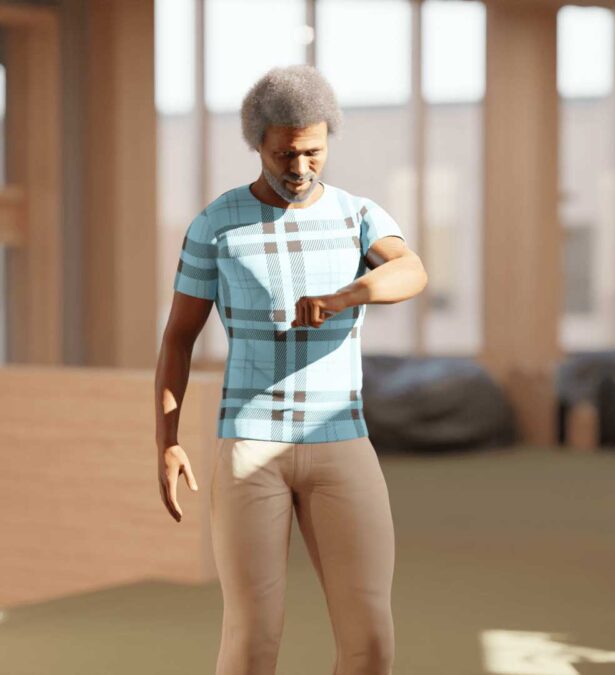

La creación de humanos digitales puede ser un proceso laborioso, por lo que ayuda si hay una manera de poner en marcha la construcción. Ese es el objetivo del complemento Human Generator para el software 3D de código abierto Blender hecho por Alexander Lashko y Oliver J. Post.

Lashko observa que MetaHuman Generator se hizo basándose en la creciente necesidad de creación de carácter humano. Ya sea para películas, juegos, visualización arquitectónica, creación de contenido de video o simplemente obras de arte digitales; los personajes humanos juegan un papel importante en el proceso de diseño. Del mismo modo, con el creciente potencial del software Blender y su comunidad; pensamos que tener una herramienta nativa ayudaría a los creadores con sus proyectos.

Los personajes humanos digitales totalmente manipulados disponibles en el complemento se pueden personalizar según diferentes géneros, etnias, formas corporales, tipo de cabello y edad. La ropa presentó un desafío interesante para Lashko y Post, debido a las interpenetraciones. Una solución que se nos ocurrió fue ocultar las partes del cuerpo que están cubiertas por la ropa. Esto también ahorra rendimiento, ya que el motor de renderizado no requiere calcular las partes ocultas.

Los usuarios están creando humanos digitales sin saber cómo

Al igual que muchas de las aplicaciones discutidas aquí, la idea detrás de las herramientas de Reallusion es permitir que la creación compleja de humanos digitales se realice sin que el usuario tenga que comprender necesariamente toda esa complejidad. Pero eso no significa que no sea complejo bajo el capó.

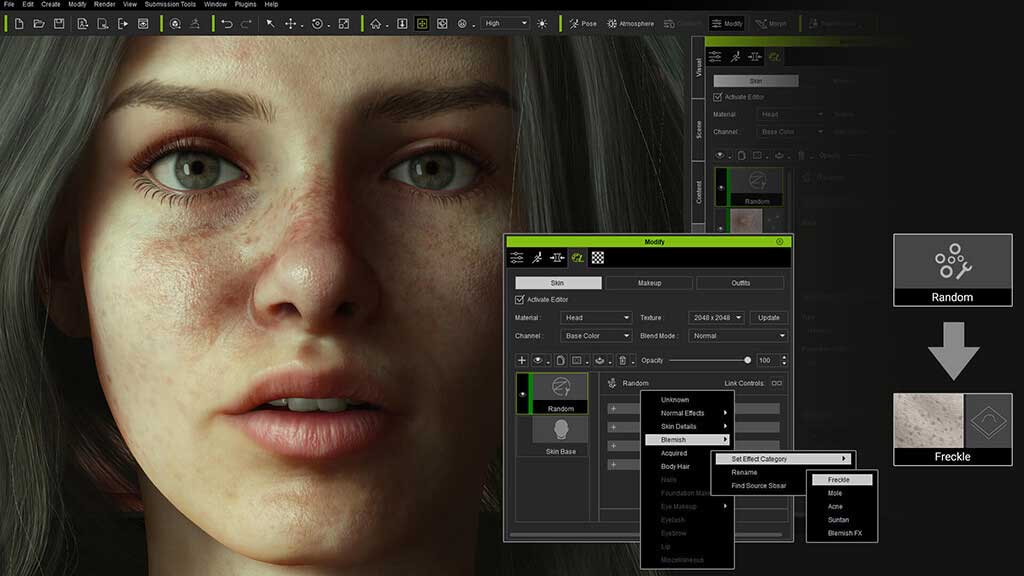

Cada elemento de desarrollo para los humanos digitales tiene un obstáculo que cruzar para la apariencia y el movimiento. La apariencia de la piel implicó un esfuerzo extenso para proporcionar a los usuarios el equilibrio de facilidad de aplicación y capacidades profundamente detalladas. Desarrollamos un sistema completo de varias capas para abordar la apariencia de la piel y cómo los usuarios podían editar y personalizar su apariencia.

Dondequiera que veamos desafíos en el flujo de trabajo, nuestra misión es resolverlos, especialmente cuando se llega a cosas realmente difíciles como la animación. Cuanto más podamos democratizar eso, más vamos a dar capacidad a los narradores, diseñadores y desarrolladores para ampliar su visión con herramientas más poderosas pero accesibles.

A partir de los detalles básicos de la piel y los micro normales trabajamos con TexturingXYZ. Un líder de la industria en activos de piel para ayudar a superar algunos de los desafíos convincentes de los micro detalles para nuestro diseño en capas. SkinGen se convirtió en el editor de apariencia en capas desarrollado para que los usuarios tengan acceso a cada elemento de la piel. Lo que resulta en una herramienta optimizada para controlar la piel del humano digital de la cabeza a los pies y de la piel humana a la piel de la criatura; el maquillaje glamoroso se ve a las heridas espantosas.

Personalización de MetaHuman Creator

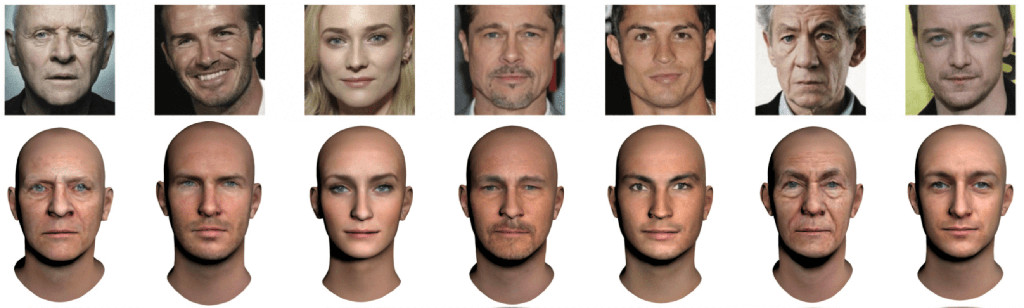

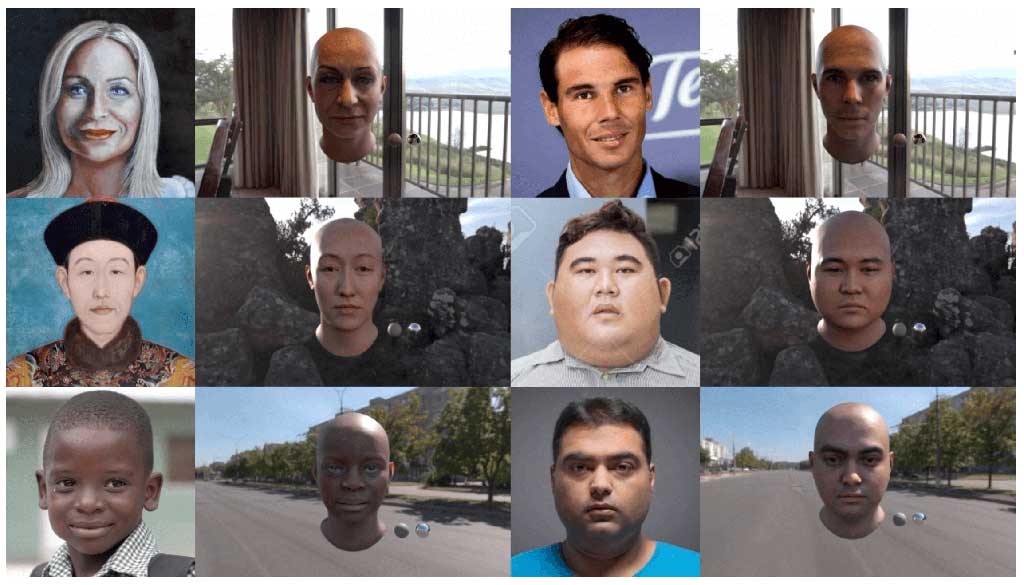

Otro desarrollo importante en la democratización de los humanos digitales es la capacidad de crear casi instantáneamente semejanzas 3D realistas de personas reales a partir de fotografías individuales. Esta es un área en la que Opera Pinscreen; habiendo desarrollado recientemente varias nuevas tecnologías y soluciones para hacer accesible a los consumidores la creación de avatares fotorrealistas; así como aplicaciones que hacen pleno uso de humanos virtuales desplegables y personalizados.

Nuestra última tecnología de digitalización de avatares basada en fotografías consiste en un algoritmo altamente robusto. Para generar avatares 3D normalizados a partir de fotografías de entrada altamente sin restricciones. Esto significa que puede tomar fotografías de entrada de sí mismo en condiciones de iluminación muy desafiantes. Puede estar sonriendo o mirando hacia los lados y el algoritmo aún puede producir una cabeza de avatar 3D normalizada de iluminación consistente con expresiones neutras. Esto es extremadamente importante para renderizar personajes CG totalmente paramétricos en cualquier entorno virtual y para la animación basada en el rendimiento.

Para demostrar su solución, Pinscreen ha estado construyendo una aplicación de chat inmersiva llamada PinScape. Se demostró en el Real-Time Live de SIGGRAPH 2021! La idea es construir un sistema de comunicación basado en realidad virtual que pueda ir más allá de la videoconferencia 2D tradicional. Al principio, un usuario se tomaba una selfie usando una cámara web; y el sistema crea automáticamente un avatar completo de cuerpo completo a partir de esa fotografía de entrada. El avatar consiste en una cara y un cuerpo completamente manipulados; y también digitaliza el cabello utilizando una tecnología mejorada de lo que presentamos hace unos años.

Sistemas que generan humanos digitales a partir de una fotografía

El enfoque de Pinscreen para generar un avatar humano creíble a partir de una sola imagen de entrada no está exento de desafíos. Tienen que superar lo que puede ser una iluminación y sombras subóptimas; aunque por supuesto la idea es evitar la necesidad de cualquier tipo de escenario de iluminación de estudio controlado para producir el avatar. Otro desafío es que las personas a menudo sonríen en las fotografías o pueden no estar frente a la cámara. Con este fin, desarrollamos un algoritmo que nos permite extraer una imagen consistente de una persona independientemente de la iluminación. La expresión facial y la pose de una fotografía, y luego generar un modelo 3D de un avatar normalizado.

Crear tu avatar para el metaverso

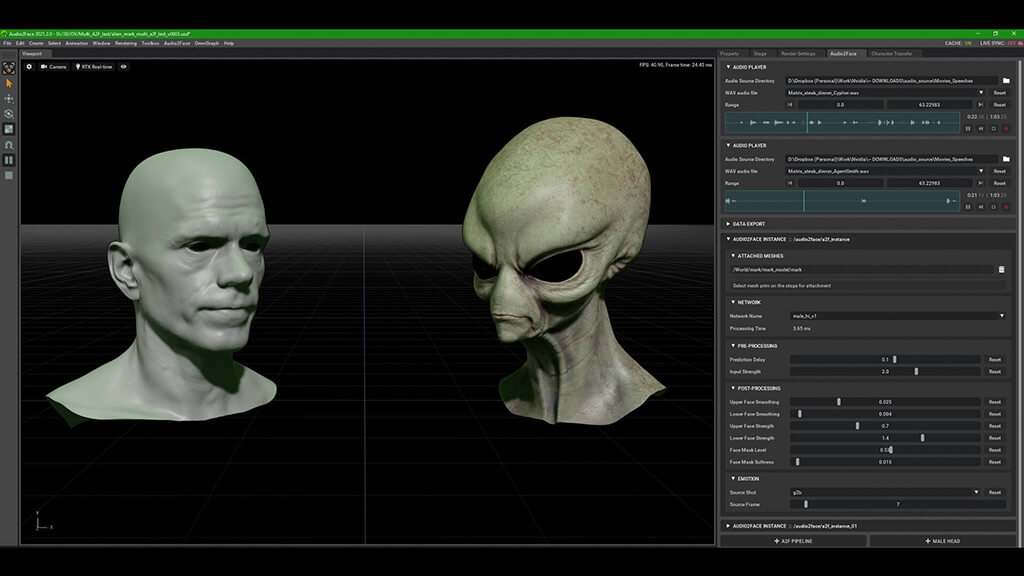

El desarrollo de MetaHuman Creator para animar tu creación humana digital es, por supuesto, tan importante como construirla. Hay innumerables opciones para la captura facial y la captura de movimiento para hacer esto; mientras que otro método ha sido tomar una pista de audio y, utilizando IA, generar una animación facial expresiva correspondiente a partir de esa fuente de audio. La aplicación Omniverse Audio2Face de Nvidia permite esto, e incluso tiene un carácter 3D precargado llamado «Digital Mark» para que los usuarios comiencen.

La intención detrás de la aplicación tenía que ver con la accesibilidad, explica Simon Yuen, Director de Graphics AI en Nvidia. En este momento, si quieres crear un personaje 3D, debes ser un experto en dominios para hacerlo.

Audio2Face está diseñado con un propósito muy específico en mente, para ayudar a simplificar la animación facial basada en voz al tiempo que mejora la calidad de las soluciones automatizadas de hoy en día. El método aprovecha el aprendizaje profundo y se ejecuta en tiempo real. Admite personajes realistas o estilizados y no se requiere aparejo ni entrenamiento de IA para usarlo. Pronto apoyará un rango más amplio de movimiento y emoción para toda la cara. Y está diseñado para complementar y trabajar con otras herramientas y flujos de trabajo existentes.

Audio2Face continúa actualizándose y ahora con soporte de blendshape, por ejemplo. Los usuarios pueden volver a apuntar a cualquier rostro humano o de aspecto humano en 3D; e incluso a rostros más alienígenas o de estilo animal. Hemos probado desde rinocerontes hasta extraterrestres y otras cosas; y planeamos tener más datos pre-entrenados disponibles con Audio2Face y un mejor soporte de una mayor variedad de voces e idiomas».

Cuando se requiere un tipo muy diferente de rostro

Los reemplazos faciales en el documental Welcome to Chechnya (2020) de David France llamaron la atención de muchas personas. No solo por la delicada forma en que protegieron las identidades de quienes aparecen en la película que corrían el riesgo de sufrir persecución por parte de la república rusa de Chechenia; sino también por la forma en que se lograron con la IA y las técnicas de aprendizaje automático. Al final, lo que finalmente se produjo fueron «nuevos» humanos digitales.

Fue especialmente difícil crear una interfaz de usuario para la generación de piel humana creíble. Nuestro Shader de piel es uno de los Shaders más complejos que hemos hecho en Epic; y destilarlo a unos pocos controles deslizantes intuitivos fue un desafío. Tuvimos que investigar muchas técnicas que involucran el aprendizaje automático y los usos pragmáticos del análisis de componentes principales (PCA;); y la separación de frecuencias para llegar allí, pero estamos contentos con los resultados.

El supervisor de efectos visuales Ryan Laney supervisó ese trabajo, tomando a los nuevos artistas como dobles de cara y enmascarándolos sobre los temas originales. Con la ayuda del aprendizaje automático y la composición tradicional. El enfoque adoptado encajaba con el presupuesto limitado de la película; y también significaba que no eran necesarios avatares digitales fotorrealista caros y lentos, completamente CG. Además, no fue exactamente el mismo proceso que el fenómeno actual de las falsificaciones profundas; que ahora también es un conjunto de herramientas ampliamente accesible, aunque ciertamente comparte algo de tecnología.

El reto al desenfocar caras de Humanos digitales

Un aspecto interesante de las tomas finales fue cierta suavidad notable o desenfoque en las caras; que de hecho se retuvo deliberadamente en los humanos digitales. Aprovechamos el lenguaje visual de esa suavidad para ayudarnos a mantener la integridad periodística. Hubo un momento de la producción donde no estaba seguro de si lo que estaba en la pantalla era el doble o el original. Entonces, realmente nos ayudó tener esos indicadores visuales, pero la integridad periodística fue la razón por la que mantener la mirada suave se quedó».

Laney ha llegado a referirse a la técnica de creación humana digital de su equipo, que está utilizando en otros proyectos, como «velos digitales». También estamos llamando al proceso reemplazo automatizado de la cara. Siento que encaja con la analogía del reemplazo de diálogo automatizado o ADR. Capturamos los datos y hacemos esta sesión de entrenamiento para casar las caras, y luego todavía hay trabajo involucrado para colocarlo. Ese reemplazo facial automatizado es el proceso que produce velos digitales.

Ya hemos publicado artículos sobre MetaHuman Creator anteriormente, puedes verlos aquí. Y si quieres tener toda la información y comentarios sobre MetaHuman Creator agrupada, puedes verla en el hilo dedicado del foro, sigue leyendo…