Guía de la animación en tiempo real en la que Epic Games trata de abarcar los campos más destacados de la tecnología gráfica que nos envuelve en estos últimos años.

Algunos de ustedes pueden preguntarse últimamente: ¿Qué es todo este alboroto que escucho sobre la animación en tiempo real? ¿Cambiador de juego disruptivo, dices? ¿El futuro del desarrollo visual colaborativo? Estas preguntas no son nada nuevo en muchos círculos creativos. Pero no hemos visto muchos escritos sobre la inevitable convergencia de los enormes mundos de la tecnología de motores de juegos; y el entretenimiento animado 2D y 3D producido tradicionalmente en cine y televisión.

La vieja frase «Nunca los dos se encontrarán» de repente me viene a la mente. Bueno, todo eso está cambiando. Rápidamente. Esos «gemelos» ahora están corriendo uno al lado del otro por el mismo twack. Lo que se estaba filtrando lentamente en el discurso de la producción de entretenimiento convencional. Con un innovador esfuerzo previo aquí y un largometraje realizado completamente en un almacén allí; ahora es una verdadera inundación repentina.

La pandemia

La pandemia de COVID-19 obligó a los estudios a descubrir flujos de trabajo de producción remotos y basados en la nube. Lo que provocó una ree-valuación de sus procesos lineales. De repente, las herramientas y los flujos de trabajo alternativos que solían considerarse demasiado perturbadores para sus prácticas probadas y verdaderas estaban sobre la mesa, con la tecnología en tiempo real al frente y al centro. Sin embargo, una cosa es segura: la aceptación, la integración y el despliegue se sienten como un imperativo en lugar de una incursión.

Enfrentados a un grupo de talentos no lo suficientemente grande (y ya no nómada); los estudios están adoptando todo tipo de metodologías de producción para manejar una explosión sin precedentes de producción de animación. Impulsada por streamers insaciables que exigen un gran volumen de características, episodios y cortos con imágenes de alta calidad producidos en un tiempo récord a bajo costo para todos los grupos demográficos, géneros, idiomas y culturas imaginables. ¡Es agotador solo decirlo, y mucho menos producirlo!

Por cada espectáculo taquillero que puede permitirse el lujo de cinco o seis años de desarrollo y producción; hay cientos que se están concibiendo, desarrollando y poniendo en producción mucho más rápido que nunca. La preproducción rápida, con equipos remotos más pequeños, se desplaza necesariamente hacia cualquier conjunto de herramientas que permita un desarrollo más rápido. Previs, que se utiliza para presentar escenas complejas, coreografiar acrobacias, calcular ubicaciones de cámara complejas.

Una herramienta indispensable

Además del desarrollo de la historia, de repente se convierte en una herramienta increíblemente importante para los directores, que ahora pueden sentarse con un pequeño equipo y visualizar un espectáculo completo, escena por escena, en en tiempo real, con imágenes de alta resolución, composición de fotogramas e iluminación.

Los flujos de trabajo de animación en tiempo real están facilitando el control creativo de formas sin precedentes. ¡Puede crear un prototipo de toda su película antes de tener que contratar a un servicio de catering!

Nada de esto ha sucedido por accidente o en el vacío. La producción en tiempo real impulsada por la tecnología que utiliza motores de juegos ha impulsado todo tipo de innovación durante años. Lo hace en muchos estudios conocidos como ILM y Wētā FX; como la integración de captura de rendimiento en el set o escenarios de pared LED que integran FX en la cámara.

Pero si ha estado prestando atención, habrá visto que Epic Games y Unreal Engine, a través de iniciativas como el programa Epic MegaGrants. Que han estado apoyando y celebrando el trabajo de miles de artistas individuales y pequeños equipos de estudio durante años. . Epic ha estado impulsando la tecnología de motores de juegos y las canalizaciones de animación en tiempo real en todas las áreas imaginables de producción de contenido; no solo en el entretenimiento. Es casi como un secreto que sucede a simple vista.

¿Por qué es todo esto importante?

Es importante porque los artistas, por naturaleza, adoptarán cualquier herramienta o medio de producción que les dé la más mínima ventaja. Las herramientas de animación en tiempo real ofrecen a los equipos creativos el lujo de realizar todo tipo de cambios con efecto inmediato. No hay horas de espera, días o incluso semanas para obtener resultados. Las imágenes finales o casi finales están literalmente al alcance de la mano.

Argumente como quiera que el canal de producción lineal tradicional sigue siendo el rey (y lo es). Pero ya no puede ignorar el hecho de que la animación en tiempo real se está convirtiendo rápidamente en un flujo de trabajo cada vez más importante; incluso imperativo, en cualquier canal creativo serio.

¡Ese gemelo seguro ha seguido rodando toda la noche!

En más de 20 años de entrevistar a cientos de los principales supervisores de VFX, supervisores de animación, supervisores de CG y similares; y hacer la pregunta: ¿Le preocupa que la tecnología de producción ejerza demasiado control sobre el proceso creativo? Siempre he recibido la misma respuesta: La tecnología de producción siempre debe apoyar la visión del director.

Las producciones de animación y efectos visuales son increíblemente difíciles, exigentes y exigentes. Las imágenes complejas requieren enormes cantidades de planificación, disciplina, talento y recursos para producir. Nunca hay suficiente tiempo, personas o recursos. Alguna vez.

Los motores de juegos brindan a los equipos acceso inmediato a contenido repleto de activos de alta resolución. Simulaciones y movimiento basados en la física; texturas y ropa realistas; todo tipo de partículas FX; y cámaras e iluminación compleja; todo controlado en tiempo real para una toma de decisiones rápida, iterativa y creativa nunca antes alcanzable. Puede ser disruptivo, pero ciertamente no es trivial; ni la locura de los pioneros centrados en el juego que nunca aprendieron a respetar las líneas de producción de animación probadas y verdaderas.

Guía de la animación en tiempo real

La animación en tiempo real puede no ser la caballería cargando colina abajo todavía. Es más como tener un amigo confiable que sabes que siempre aparecerá con poca antelación, ansioso por echarte una mano. Y ese es el tipo de ayuda que siempre es bienvenida.

Dan dirige Animation World Network (AWN.com), una de las mayores editoriales de noticias e información sobre animación y VFX. Dan ha formado parte de jurados, ha pronunciado conferencias magistrales y moderado paneles en numerosos eventos de la industria, como Animation Masters Summit y FMX; y actualmente es presidente del Computer Animation Festival para SIGGRAPH Asia 2022.

Introducción a la guía de la animación en tiempo real

La animación se trata, en esencia, de dar vida a las historias a través de personajes, mundos y actuaciones. Los artistas crean historias siguiendo un canal de producción, una serie de procesos diseñados para que el flujo de trabajo sea fluido y eficiente. Pero incluso la tubería más fluida requiere una supervisión y un refinamiento persistentes para que todo suceda. Para llegar al momento en que todo se une para producir una obra de arte.

Trabajar dentro de una tubería es esencial para terminar un proyecto en cualquier período de tiempo razonable. Sin embargo, las canalizaciones de animación no están escritas en piedra; los estudios siempre están buscando formas de aprovechar las nuevas tecnologías para avanzar tanto en la eficiencia creativa como en la económica.

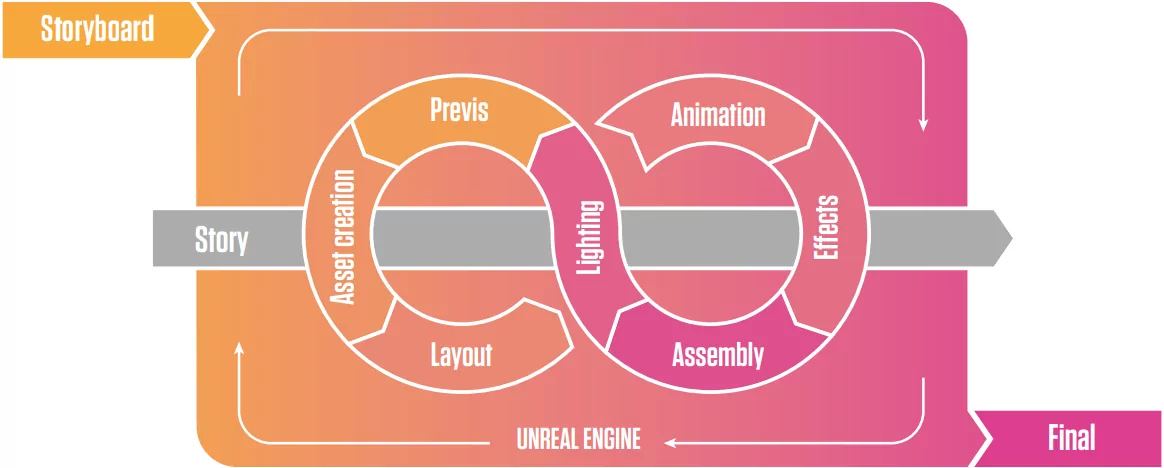

Es lógico pensar que cualquier cambio en los procesos de animación que hayan funcionado durante décadas no debe comprometer la narración de historias. Es ideal hacerla mejor, más fácil y más rápida. Aquí en Epic Games, vemos a la industria al borde del precipicio de un nuevo paradigma para la animación; una canalización en tiempo real que brinda a los creadores más oportunidades para iterar; explorar, experimentar y descubrir, desde el desarrollo de la historia hasta el renderizado final.

Guía de la animación en tiempo real

En esta guía, obtendrá un recorrido por las canalizaciones en tiempo real que se utilizan hoy en día y descubrirá cómo los productores; directores, TD y artistas han eliminado los puntos débiles comunes en la canalización tradicional con este nuevo flujo de trabajo.

Estos profesionales de la industria, que han hecho la transición y están produciendo proyectos en Unreal Engine; hablarán sobre la libertad creativa que han disfrutado al colaborar e iterar en tiempo real. Comparte cómo las fases de producción como el diseño, la animación y la iluminación ya no son lineales; sino que ahora se superponen de manera fluida; y expresar cómo ver los píxeles finales antes les permite contar mejores historias.

También le informarán sobre los beneficios intangibles, como la emoción de ver que el proyecto se lleva a cabo tan rápido; y una mayor satisfacción del artista cuando los cambios aparecen instantáneamente.

¿Para quién es esta guía de la animación en tiempo real?

El mundo del contenido de animación está cambiando: cómo lo hacemos, cómo lo entregamos y cómo lo consumimos.

El contenido lineal al que nos hemos acostumbrado se está explotando más allá del cine y la televisión en nuevos medios como experiencias interactivas; realidad virtual y aumentada, entretenimiento basado en la ubicación y más. Desde este punto de vista, queda claro que los mundos de la producción de animación y el desarrollo de juegos están convergiendo; de una manera que brinda a los creadores más oportunidades para contar sus historias. Esta convergencia incluye la creciente aceptación de un motor de juego como plataforma para el desarrollo de contenido animado.

Epic Games, el creador de Unreal Engine, ha producido The Animation Field Guide para cualquier persona interesada en aprender más sobre las muchas facetas y beneficios de producir proyectos de animación con los flujos de trabajo en tiempo real que un motor de juego fomenta naturalmente.

Guía de la animación en tiempo real

Si usted es un director que quiere agilizar el proceso de revisión para tener más oportunidades de repetir su visión. Un artista que necesita comentarios instantáneos sobre los cambios de iluminación o animación; o un director técnico que busca impulsar más eficiencias en toda la tubería, esta guía es para ti.

Y cuando esté listo para sumergirse en profundidad para obtener más información y orientación técnica; puede explorar las ideas, los consejos y los trucos compartidos por los profesionales de la industria y el personal de Epic en nuestra nueva comunidad de desarrolladores de Epic. Como la Guía técnica para la creación de contenido lineal.

Unreal Engine y canalizaciones en tiempo real

Durante los últimos 25 años, Unreal Engine se ha establecido como la principal plataforma abierta para juegos AAA. También ha visto una amplia adopción en múltiples industrias. En el campo de la arquitectura, los diseñadores han descubierto que pueden usar tecnología en tiempo real para llevar sus visiones a los clientes mucho más rápido. En la industria automotriz, Unreal Engine impulsa sesiones de diseño colaborativo, simuladores de conducción, pruebas de vehículos autónomos y soluciones HMI (interfaz hombre-máquina).

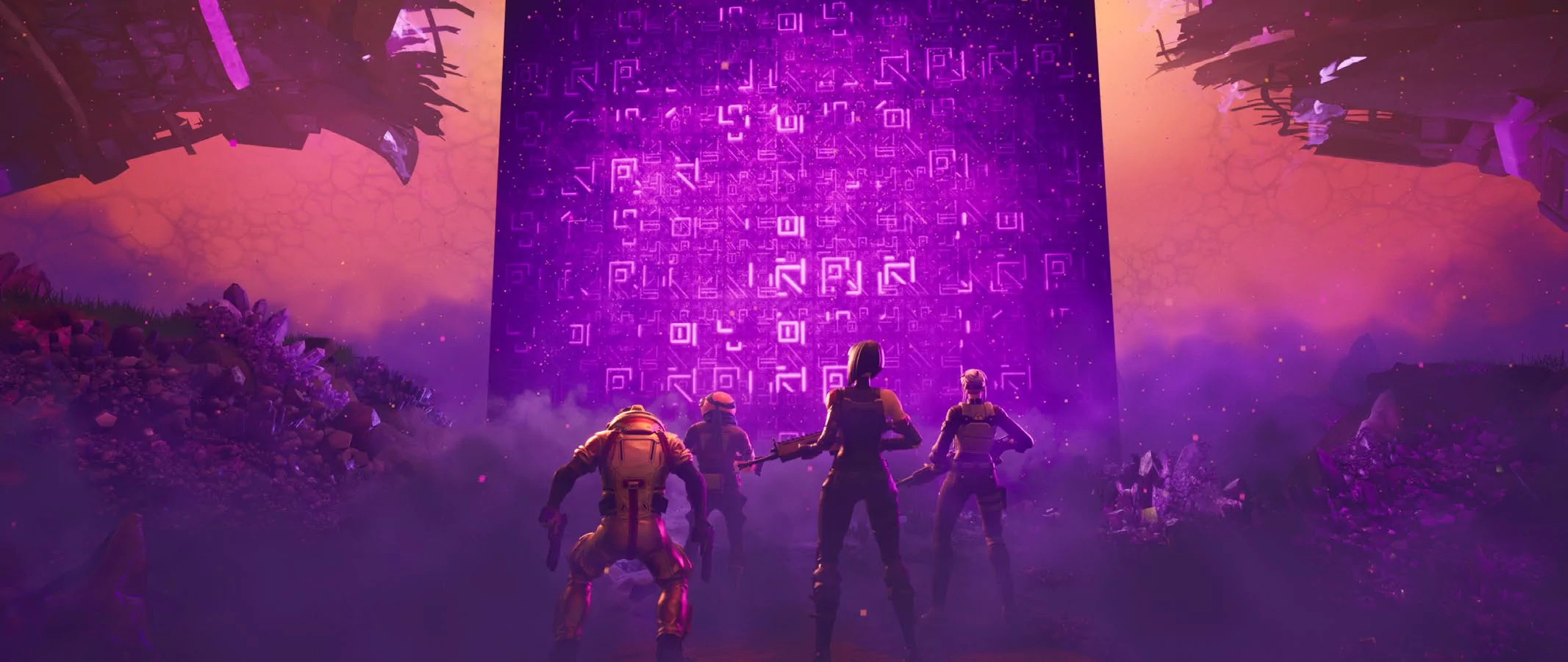

La industria del cine y la televisión no ha sido una excepción: los equipos de producción han aprovechado Unreal Engine durante años; desde la etapa previa hasta la posproducción. A la serie de Disney The Mandalorian, por ejemplo, se le puede atribuir el mérito de demostrar la viabilidad de la tecnología en tiempo real; y los efectos visuales en la cámara para producir contenido de calidad cinematográfica.

Unreal Engine está experimentando una adopción acelerada en la industria de la animación como una plataforma creativa para el desarrollo desde la preproducción hasta la producción y la posproducción; y no solo para el renderizado en tiempo real. De hecho, si su objetivo al implementar una canalización en tiempo real es simplemente reemplazar su flujo de trabajo y software de renderizado existentes; es menos probable que tenga éxito y se perderá muchos beneficios.

Guía de la animación en tiempo real

Como plataforma, Unreal Engine afecta todos los aspectos de su flujo de trabajo, desafiando las normas familiares de una canalización tradicional. Entonces, si solo está aquí para reemplazar su renderizador, esta guía no es para usted. Pero si está listo para saltar y ver cómo un flujo de trabajo en tiempo real puede mejorar toda su canalización; siga leyendo mientras compartimos ideas e historias de usuarios sobre cómo los estudios están haciendo la transición.

Los animadores empezaron a animar para contar historias, y una canalización en tiempo real hace que esto sea más posible que nunca. Estamos entusiasmados de estar a la vanguardia de una nueva forma de trabajar que tiene el potencial de llevar la industria a alturas aún mayores, y esperamos que se una a nosotros. Empecemos.

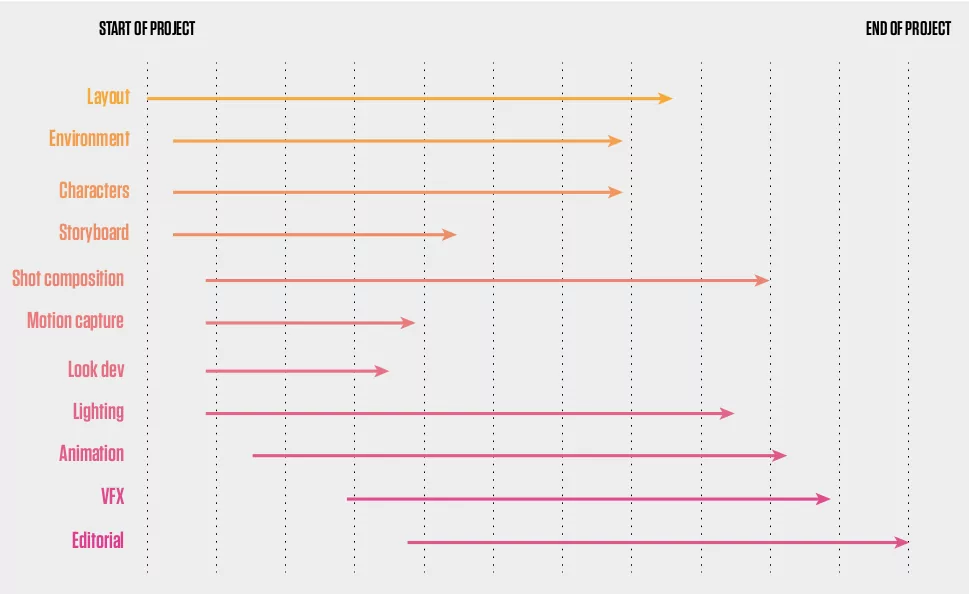

Evolución de la canalización en tiempo real

Para comprender mejor los beneficios de una canalización en tiempo real; comencemos con un viaje rápido por el carril de la memoria para volver a visitar las canalizaciones tradicionales desarrolladas a lo largo de la historia de producción de animación. Explorar estas canalizaciones lineales brindará información sobre las diferencias entre estos enfoques y los flujos de trabajo paralelos de una canalización en tiempo real.

Canalizaciones lineales

La animación ha capturado los corazones y la imaginación de los creadores desde sus inicios. Incluso antes de que Disney y Nine Old Men revolucionaran e impulsaran la animación a la cultura dominante en la década de 1930; su historia se estaba escribiendo.

La década de 1800 vio una serie de desarrollos en la ilusión estroboscópica, comenzando con el fenaquistiscopio en 1833; una simple tarjeta redonda con dibujos y ranuras que el espectador giraba y miraba.

Esta invención condujo directamente a varias máquinas más basadas en ilusiones, como el zoótropo y el praxinoscopio. Si bien todos solo podían reproducir bucles, el praxinoscopio avanzó la ciencia mucho más con la capacidad de mostrar una animación mucho más larga; el uso inteligente de espejos para una visualización más fluida y la proyección de imágenes para que varias personas pudieran disfrutar de la presentación a la vez.

El advenimiento del cine como entretenimiento a principios del siglo XX le dio al mundo un nuevo medio para compartir historias animadas. Después de producir Blancanieves y los siete enanitos, aclamada por la crítica, la década de 1900 perteneció a Disney; que se esforzó por alcanzar estándares de calidad cada vez más altos en cada nueva película que producían.

Guía de la animación en tiempo real

Cada proyecto requería los servicios de cientos de empleados talentosos y dedicados; animadores, artistas de tinta y pintura, fotógrafos, editores de películas, locutores, ingenieros de sonido y muchos otros.

Disney recurrió continuamente a la tecnología para mejorar la narración. Las contribuciones de Disney a la evolución de la animación incluyen la adición de sonido totalmente sincronizado a la animación; como se vio por primera vez en el corto Steamboat Willie (1929); descubrir cómo combinar la acción en vivo con la animación para la película Song of the South (1946); y desarrollo de procesos xerográficos para acelerar la producción, utilizados en la película 101 dálmatas (1961).

Disney también aprovechó las herramientas y las innovaciones del momento (la cámara multiplano, la rotoscopia y muchas otras); para agilizar el proceso de producción y mantener un alto nivel de calidad visual y narración.

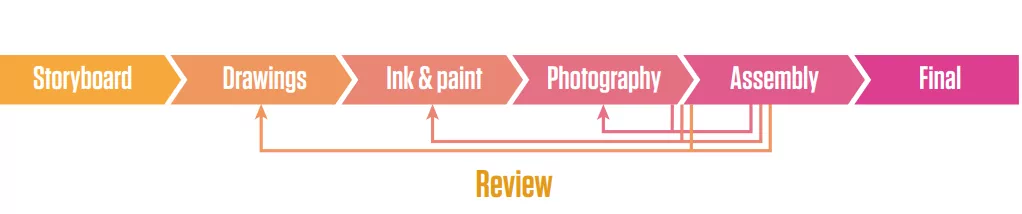

Canalización tradicional de animación 2D/Cel Pero incluso con los avances tecnológicos creados por Disney. Las canalizaciones 2D eran muy lineales, tomaban mucho tiempo para producirlas y requerían mucha mano de obra.

Guía de la animación en tiempo real

En un proceso de línea de montaje, un animador comenzaría dibujando contornos de poses clave en hojas de celuloide (también conocidas como cels); entregaría las hojas a tweeners que conectarían la acción y las pasaría para entintarlas, pintarlas y fotografía.

Cualquier cambio por parte de un director tendría un efecto exponencial en el proceso. Incluso un cambio menor en el color haría que el proceso se volviera a pintar a mano; y los cambios más detallados podrían significar comenzar una secuencia desde cero con nuevos dibujos. Se pueden perder días, semanas, a veces meses de trabajo.

Incluso en las canalizaciones más eficientes del momento, cada película tardó años en materializarse.

Pipeline tradicional de animación 2D/Cel

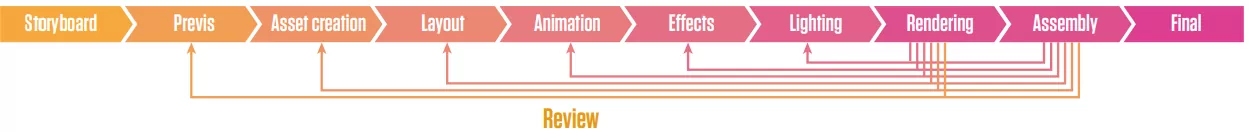

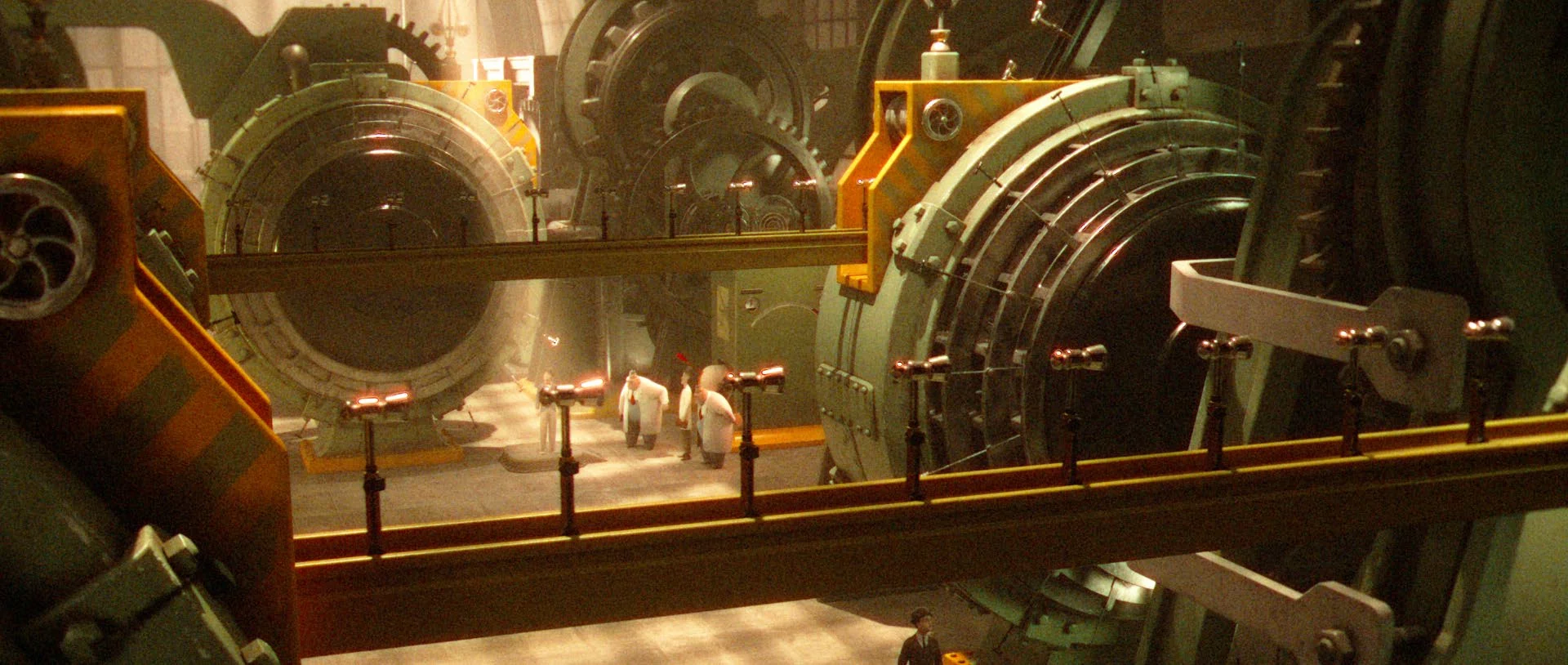

El lanzamiento de Toy Story de Pixar en 1995 puso la animación 3D en el mapa para audiencias de todo el mundo. Inspirados a legiones de estudios a participar en el juego a medida que el precio de las computadoras comenzó a disminuir drásticamente; y el software 3D listo para usar estuvo disponible ( y asequible) para PC de escritorio.

Si bien las computadoras también mejoraron la eficiencia en las canalizaciones 2D tradicionales, la revolución 3D realmente abrió nuevas posibilidades creativas en la narración de historias que posiblemente fueron superadas solo por el impacto de Disney en la animación en la década de 1930. Pero esta innovación también vino con sus propios desafíos, y lo que quedó fue un proceso de línea de ensamblaje en gran parte lineal con algunos departamentos nuevos que surgieron en el camino.

Las canalizaciones 3D aún requerían una mano de obra significativa, pero con la introducción del proceso altamente computacional de renderizado; las legiones de artistas de tinta y pintura fueron reemplazadas por salas llenas de costosas computadoras.

Guía de la animación en tiempo real

Al igual que con el proceso 2D, a los directores les tomó mucho tiempo ver la visión final convertirse en realidad, y cualquier cambio implicó costosas combinaciones de horas de mano de obra y de computadora para arreglarlo. Los cambios tenían que retroceder en la tubería a través de múltiples departamentos, y eran costosos y requerían mucho tiempo.

Año tras año, la tecnología de animación 3D ha continuado ampliando los límites de la fidelidad visual con funciones como materiales basados en la física, pelo y piel, y simuladores de física. Pero a pesar de estos avances, la cantidad de horas-hombre requeridas para terminar un proyecto de animación sigue siendo bastante alta, lo que hace que el tiempo para producir una película o serie animada todavía se mida en años.

Pipelines y Creatividad

Si bien los flujos de trabajo de animación tradicionales han funcionado durante muchos años, tienen un inconveniente importante: se debe realizar una gran cantidad de planificación por adelantado para evitar cambios en el futuro, ya que los cambios son costosos y requieren mucho tiempo.

Debido a que la visión creativa final del director no se realiza hasta el final de la producción, los directores no tienen la libertad de iterar y experimentar libremente; deben esperar que su visión se haga realidad y deben ser frugales con sus cambios.

La conclusión es que la inflexibilidad inherente a una tubería tradicional puede ser sofocante para la creatividad.

Una verdadera mejora de la canalización lineal tradicional interrumpiría por completo su naturaleza lineal y proporcionaría un mayor nivel de flexibilidad creativa a lo largo de todo el proceso de producción. Tal tubería pondría las tareas en paralelo para una mayor eficiencia y daría a los artistas la oportunidad de iterar en cualquier punto del camino con una pérdida mínima de tiempo de producción.

Canalización en tiempo real

El término «tecnología en tiempo real» abarca una serie de herramientas, procesos y flujos de trabajo, que incluyen:

- Representación en tiempo real, que los motores de juego emplean para mostrar el entorno y la acción con la máxima calidad a medida que el jugador se mueve.

- Captura de la actuación en tiempo real, donde los movimientos de un actor se digitalizan y transfieren directamente a un avatar mientras el actor actúa.

- Colaboración en tiempo real, donde un grupo de artistas o ingenieros trabajan juntos en el mismo proyecto en una sesión en vivo, actualizando modelos, texturas, iluminación y animación sobre la marcha.

- Cabello y pelaje en tiempo real, donde los artistas pueden ver la versión final en lugar de tener que trabajar con proxies.

- Efectos visuales en tiempo real, donde los resultados completos de los efectos de partículas, simulaciones físicas y otros procesos posteriores que consumen mucha memoria se procesan y son visibles en fracciones de segundo, en lugar de pasar por un paso de composición separado.

Guía de la animación en tiempo real

Los avances en los motores de juego son la base de estas nuevas técnicas disponibles. Y cuando se combinan, estas funciones y flujos de trabajo se convierten en la base de una canalización de animación capaz de lograr una alta fidelidad visual al mismo tiempo que brinda a los artistas y técnicos más libertad creativa que nunca, y también acelera la producción a través de una colaboración sencilla y una iteración rápida.

La accesibilidad, la velocidad y la iteración son los sellos distintivos de una canalización de animación en tiempo real, que lo distinguen de un flujo de trabajo de CG tradicional.

Cómo las canalizaciones en tiempo real están cambiando la animación La ventaja más obvia de usar un motor de juego para producir animación es el renderizado en tiempo real, que permite una iteración rápida y ahorra una enorme cantidad de tiempo de producción simplemente eliminando los tiempos de renderizado de horas o días de duración. la ecuacion. Pero junto con el renderizado en tiempo real viene una serie de beneficios adicionales que cambian la forma en que los equipos abordan el proceso de principio a fin, todo con el objetivo de amplificar la creatividad y la narración.

Guía de la animación en tiempo real

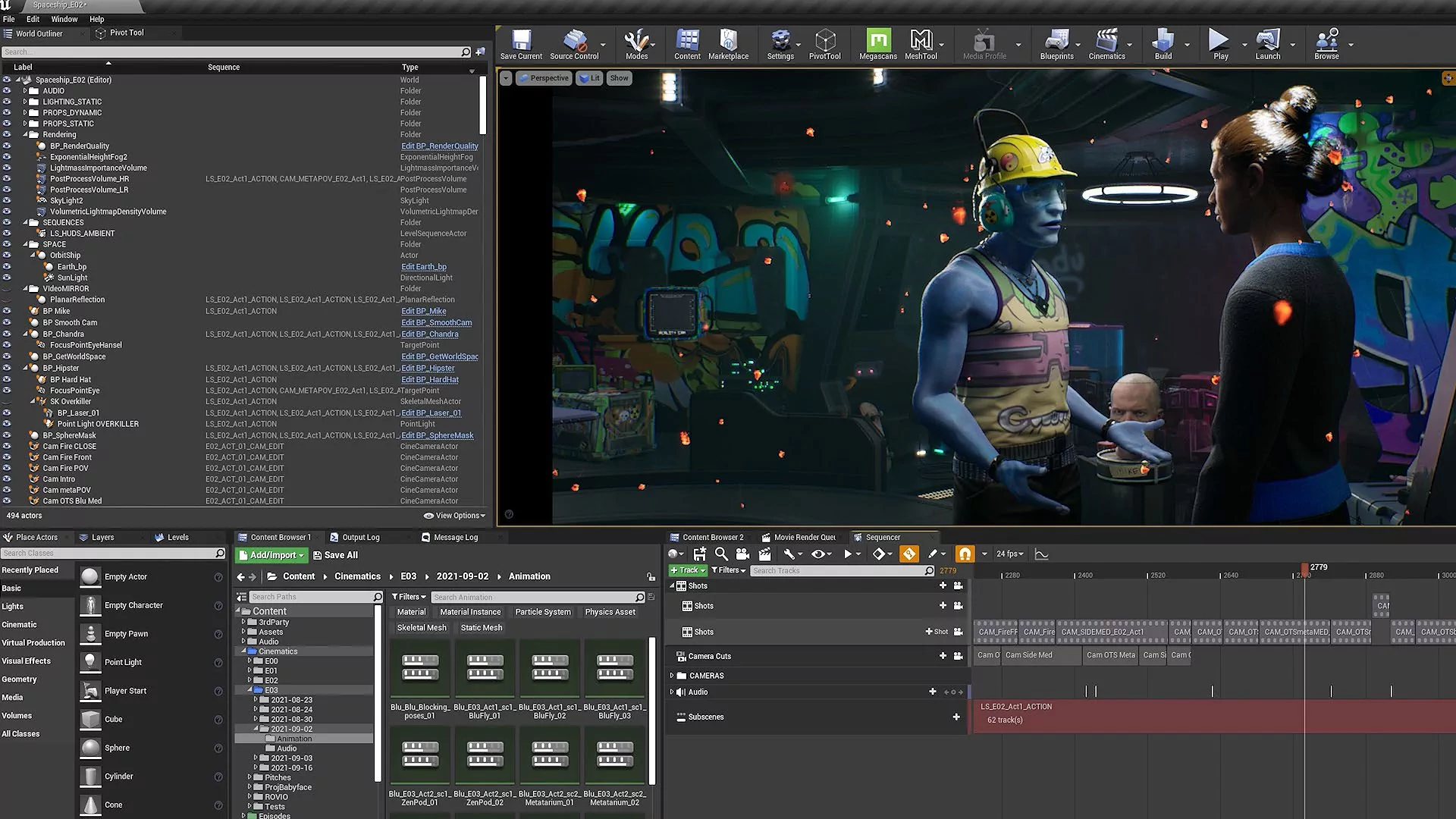

En una canalización en tiempo real, todavía se necesitan todos los trabajos y departamentos en un flujo de trabajo tradicional (diseño, bloqueo, desarrollo de apariencia, rigging, animación, iluminación y efectos especiales), pero no necesariamente ocurren en el orden en que está. acostumbrados a. Lo que ha cambiado es el momento de estas actividades, con una gran superposición entre los pasos que solían ser controlados y secuenciales.

Pipeline 3D en tiempo real

Otra diferencia está en la forma en que el diseño y las previsiones fluyen directamente hacia la producción. En una canalización tradicional, los productos de diseño y previsualización se usan comúnmente solo como referencia, y todo el trabajo duro que ha realizado su equipo se descarta a medida que avanza la producción.

Con un flujo de trabajo en tiempo real, su producción se convierte en un primer borrador tan pronto como el desarrollo de la historia, y los creativos de cada departamento pueden ajustar y pulir la pieza en el transcurso de la producción hasta su finalización. Trabajar de esta manera le da a cada departamento una visión completa del proyecto mientras avanza en el desarrollo, para que puedan contribuir de manera más efectiva al conjunto. En efecto, lleva la postproducción a la preproducción. Básicamente, ahora está «arreglándolo antes» en lugar de «arreglarlo en la publicación».

Este flujo de trabajo cambia fundamentalmente la forma en que los equipos de animación abordan la producción de principio a fin, brindándoles amplias ventajas:

- Velocidad: Trabaje más rápido y de manera más inteligente.

- Iteración: Iterar temprano y con frecuencia. Volver, descubrir, experimentar.

- Fidelidad visual: Trabaje con un alto nivel de calidad visual desde el principio y sin grandes granjas de renderizado ni largos tiempos de renderizado.

- Colaboración: Explore realmente el interior del proyecto junto con su equipo y trabaje en paralelo con otros departamentos.

Estas ventajas se traducen en beneficios creativos y ahorros en la producción:

Más oportunidades para la creatividad. Cuando los artistas tienen la capacidad de abordar rápidamente los comentarios, los directores pueden experimentar y explorar más libremente.

Más oportunidades para la visualización. Con la tecnología en tiempo real, puede comenzar antes el desarrollo del aspecto 3D, lo que informa mejor a sus artistas en el futuro. La experimentación que habría sido demasiado difícil, costosa o lenta con una canalización lineal ahora es posible.

Iteración más rápida

¿Necesitas cambiar algo? ¿Quieres probar un ángulo de cámara diferente? ¿Quieres improvisar? ¿Cómo sería esta escena durante la hora mágica? Los cambios de artista toman segundos en lugar de días o semanas. Ahora puede controlar la edición, lo que significa que puede encontrar y promulgar soluciones en el momento sin tener que avanzar en su canalización.

Entrega más rápida

El renderizado en tiempo real elimina una de las partes más largas de la producción de animación. Con tiempos de procesamiento que se pueden medir en fracciones de segundo por fotograma, se pueden generar varias versiones para su revisión, lo que reduce el tiempo total necesario para las aprobaciones. Los tiempos de respuesta más cortos tienen el potencial de acelerar la producción y reducir los presupuestos.

Mayor variedad de estilos

Desde hiperestilizado hasta fotorrealista, ahora solo está limitado por su propia imaginación, ya que Unreal Engine tiene las herramientas para crear casi cualquier aspecto que pueda soñar.

Acércate a la visión del director. Cuando el director puede solicitar nuevas tomas de captura de movimiento en el acto, ver una docena de opciones de iluminación en unos minutos y explorar diferentes posiciones de la cámara con el deslizamiento del mouse, ellos (y todo su equipo) pueden participar en momentos de descubrimiento.

Mejor narración. Durante la producción, no es raro que el equipo encuentre mejores formas de transmitir una historia más allá del guión gráfico o guión original. Con una tubería en tiempo real, experimentar con nuevas composiciones de tomas, ángulos de cámara e iluminación toma solo unos minutos, por lo que la historia recibe el mejor tratamiento posible al final.

Oportunidades transmedia

Los narradores modernos están creando experiencias para sus audiencias más allá de la narración lineal. La tecnología en tiempo real, como plataforma, brinda a los creadores más oportunidades para atraer audiencias en todos los medios: juegos, dispositivos móviles, transmisión en vivo, entretenimiento basado en la ubicación y XR, solo por nombrar algunos.

Lo que fue realmente nuevo para nosotros, cuando comenzamos a usar Unreal Engine para Yuki 7, estaba logrando un aspecto final con el que estábamos contentos que no involucrar una herramienta de composición.

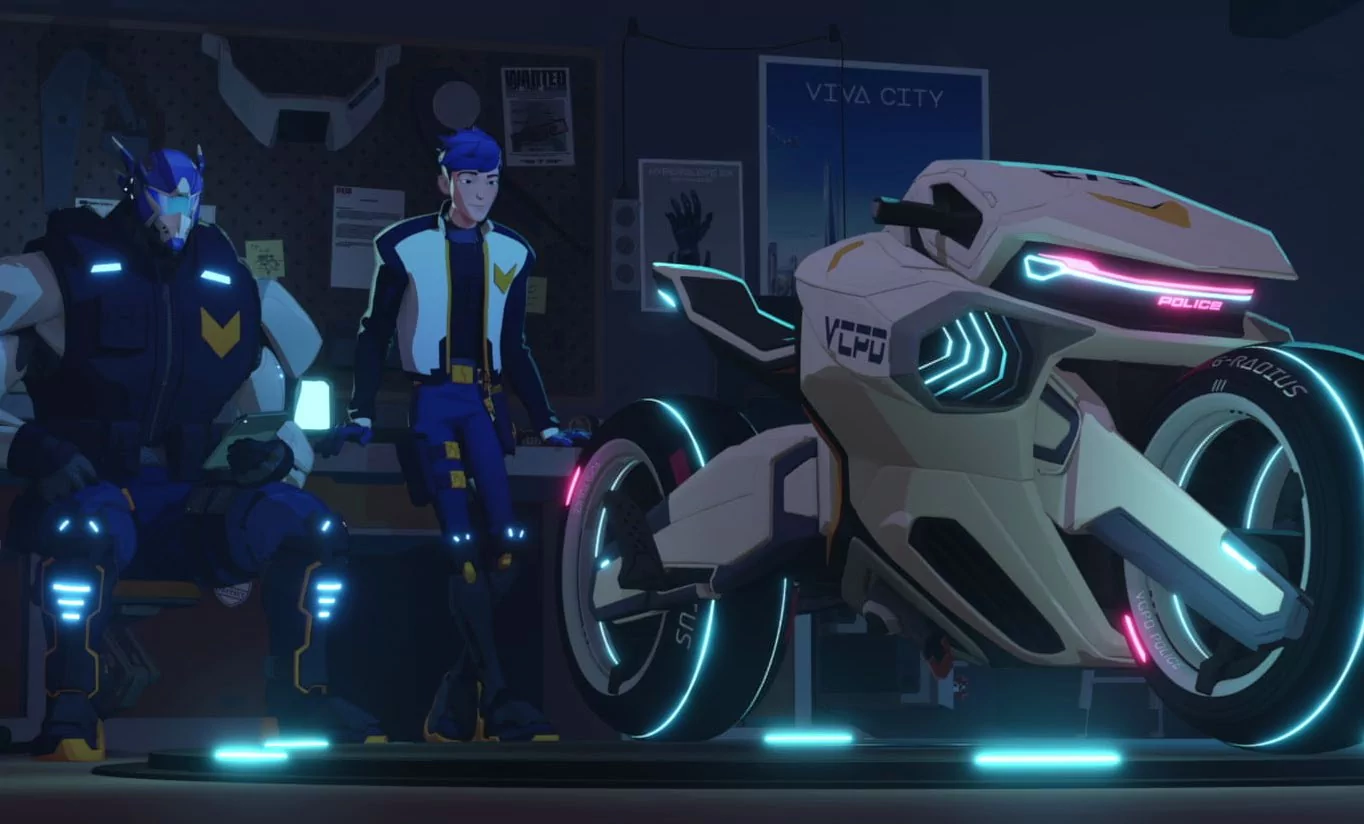

Entrevista a BRON Digital y Jason Chen y Aaron L. Gilbert

Jason Chen es Executive Vice President y Aaron L. Gilbert es CEO, BRON Studios

BRON Studios, con sede en Vancouver, se fundó en 2010 con una actitud de «cineasta primero» hacia la acción en vivo y la animación, y ha participado en numerosos proyectos ganadores de premios de la Academia. BRON Digital se lanzó como una división de BRON Studios durante la pandemia de 2020 con la intención de utilizar canalizaciones en tiempo real para los proyectos de BRON.

Fables es un recuento de cuentos tradicionales como La tortuga y la liebre, Los tres cerditos y El niño que gritó lobo, con un nuevo giro para el público contemporáneo. El estudio también está trabajando en Gossamer, una adaptación animada de la novela para adultos jóvenes de Lois Lowry sobre un hada que da sueños.

BRON Digital realmente ha adoptado una canalización en tiempo real en los últimos años. ¿Cómo se llegó a esto?

Aaron: Cuando Jason y yo nos conectamos por primera vez, él estaba trabajando conmigo en otro programa como supervisor de VFX. Y una noche a las 3 AM, estaba jugando en su iPad haciendo referencia a Unreal Engine, mostrándome arreglos rápidos en tomas, mostrándome cómo funcionan las cosas. Nunca lo había visto antes. Tenía curiosidad y le pedí a Jason que viniera a BRON y nos enseñara sobre el motor.

En ese momento, me gustaba nuestra canalización tradicional de CG. Estábamos produciendo grandes cosas de las que estaba muy orgulloso, como The Willoughbys. Sin embargo, odié que una película tomó tres años y medio, casi cuatro años para producir en nuestro estudio. Y en esos mismos cuatro años, estaba haciendo de 60 a 80 proyectos de acción en vivo.

Quería descubrir cómo poner en marcha tres, cuatro, cinco, diez proyectos animados en ese marco de tiempo de acción en vivo. Así que la pregunta era, ¿cómo se nos ocurre un enfoque de acción en vivo para la animación? Empecé a hablar de esto hace 10 años. De hecho, escribí un artículo sobre un enfoque de acción en vivo para la animación, con nuestro exjefe de producción en BRON.

Luego sucedió la pandemia mundial, y eso nos obligó a tomar algunas decisiones. Tuvimos varios programas de acción en vivo, una película y una serie de televisión en preparación y producción en todo el mundo, todos cerrados. Necesitábamos una línea de ingresos. Así que le pregunté a Jason si podíamos poner en marcha un equipo para esta canalización en tiempo real de inmediato, y en abril de 2020 comenzamos.

¿A qué te refieres cuando lo llamas un enfoque de acción en vivo para la animación?

Aaron: Sigue la misma estructura que una filmación de acción en vivo, usando hojas de llamadas, etc. Se sentía como una forma más eficiente de hacer las cosas.

El flujo de trabajo de Unreal Engine está mucho más cerca de un flujo de trabajo de acción en vivo que el tradicional. Lo que más me gusta de esto es nuestra capacidad de ver tantas cosas diferentes, y cómo iterar y cómo cambiar rápidamente. Al igual que la acción en vivo, podemos decir: «Hagamos esto de nuevo» o «Intentémoslo de otra manera». No tienes esa opción con la animación, si lo estás haciendo de la manera tradicional.

Eso no es nada en animación que hayas experimentado. Y para mí, ese es el enfoque de acción en vivo de la animación. Todo lo que implica hacer animación tradicional todavía tiene que suceder, pero ahora los pasos son diferentes. Puedes llevarlo adelante, mirando todo desde el momento en que comienzas.

Guía de la animación en tiempo real

Jason: La acción en vivo es definitivamente de donde proviene el núcleo de mi pasión por el cine. No hay nada como ir al set, un enorme y singular escenario sonoro. Tienes de 75 a 100 miembros de la tripulación allí, y luego, de repente, el AD grita «¡Roll!» Y entre «¡Acción!» ¡y corte!» tienes 100 artesanos enfocados en ese pequeño momento, cada uno contribuyendo con su propio arte y habilidad dentro de ese momento.

Lo que hace Unreal Engine es replicar eso. Puede tener energía enfocada e involucrar a tantas personas en flujos de trabajo remotos, sesiones de entorno multiusuario y sesiones de revisión.

En la fase de preparación, también adoptamos las sensibilidades de acción en vivo de presentar recorridos en vivo en el escenario para que nuestros directores y nuestros diseñadores de producción experimentados puedan recorrer virtualmente nuestros escenarios antes de que cualquier material o sombreador pase a los entornos. Nuestros DP miran a través del plató y dicen cosas como: “Esta esquina está un poco oscura. ¿Puedes hacer un agujero en esta esquina para que podamos tener una luz que entre por allí? Miramos una revisión al día siguiente, y todos la aprueban.

Guía de la animación en tiempo real

Y luego progresa a lo que nos encanta llamar «producción física» en el escenario. El equipo de dirección de arte presenta una muestra de diferentes materiales y colores, y tienen una sesión en vivo donde comienzan a colocar nuevos materiales o incluso colores. Hicimos esto a principios de 2020 con personas en Nueva Zelanda, Londres, Nueva York, Dakota del Norte y yo en Los Ángeles, todo en una sola sesión. Pero debido a que estamos en Unreal, no hay soportes en C, ni sacos de arena, y es mucho más eficiente. Nuestro récord personal es de más de 21 configuraciones en solo una sesión de dos horas con uno de nuestros DP en Unreal.

Una de las cosas que me hizo enamorarme de las películas fue ir al backlot de Universal y ver cómo se hacían las cosas. Es gracioso que se complete el círculo. Una canalización en tiempo real aplica esas mismas estrategias.

Ahora todo el mundo está contribuyendo. Pero lo realmente bueno es que, desde el punto de vista del arte, en nuestros entornos, ves todas esas influencias desde una perspectiva global, que es algo que nunca anticipamos. Le das a un artista un informe para algo simple como un pasamanos, y luego, de repente, ves aparecer estos pequeños destellos de art nouveau. Tú dices: “Eso es hermoso. ¿Quien hizo eso?» «Oh, ese fue Bruno». Todo se une en esta canalización y flujo de trabajo verdaderamente internacional.

Aaron: Si estás haciendo una película de acción en vivo, quieres que todos hablen al frente. Intrínsecamente, esta canalización trae todo su proceso, incluida la publicación y la entrega, a la discusión desde el primer día, porque debe pensar en el final para diseñar correctamente el comienzo. Para un cineasta, es algo increíble, porque puedes ver las cosas abrirse frente a ti de inmediato.

¿Cómo ha afectado el uso de un flujo de trabajo en tiempo real la velocidad y el rendimiento de la producción?

Aaron: Con la tubería de Unreal Engine, después de menos de dos años, estamos llegando al mercado con nuestro primer programa Fables, y nuestro segundo programa poco después, y estamos en producción en nuestro tercer programa. Y hay un cuarto, quinto, sexto, séptimo y octavo detrás de eso. En una canalización de animación tradicional, todavía estaríamos a más de un año del primer programa. Esa es una realidad.

Desea poder llegar al final del día y decir: “¡Guau! Mira lo que hice. En la animación tradicional, ese momento «Wow» te lleva un año o dos para llegar. Eso es realmente difícil para un director, y para todos, realmente, preguntarse qué estamos construyendo, hacia dónde va. Eso es lo que me encanta de adoptar esta tubería de Unreal Engine en todos los ámbitos: tienes ese «¡Guau!» momento todos los días.

La canalización que creamos con Unreal es mucho más eficiente (las líneas de tiempo, las capacidades de iteración, el hecho de que puedes ver las cosas de inmediato) que una canalización de CG tradicional. Y el producto del trabajo que vemos es fenomenal. Al final del día, para mí, se trata de lo que vamos a terminar.

No estamos haciendo nada fuera de esto. Así es como lo estamos haciendo, punto, porque es muy eficiente. ¿Por qué gastaríamos un dólar en otra parte? Porque esos otros dólares no pueden hacer lo que un dólar puede hacer en Unreal Engine.

¿Capacitó a su personal actual sobre el nuevo oleoducto o tuvo que contratar gente nueva?

Aaron: En realidad hubo un cambio de cultura. Íbamos a apostar con el canal en tiempo real, y muchas personas que habían estado con BRON durante algún tiempo decidieron que querían vivir más dentro de un canal tradicional. Y nos dejaron, lo cual entendemos, y les deseamos lo mejor.

Pero las personas que querían trabajar en una nueva tubería, se quedaron. Todavía tenemos muchas personas que han sido parte de nuestro equipo durante muchos, muchos años.

Jason: También pensamos en el hecho de que muchos de nuestros increíbles colegas de nuestros programas de acción en vivo ahora están sin trabajo. ¿Cómo nos acercamos a ellos y los involucramos en el proceso? Porque creo que uno de los grandes problemas y las grandes interrupciones que han ocurrido en los últimos 10 o 15 años en los efectos visuales, especialmente, es que el equipo de acción en vivo filma el producto y dice: «¡Corte, envuelva!» y no lo ven durante seis meses a un año. Y para cuando lo ven en los cines, ha cambiado por completo porque los efectos visuales han estado en un silo.

Guía de la animación en tiempo real

Así que pensamos, traigamos a nuestros artistas de acción en vivo, nuestros DP de acción en vivo y diseñadores de producción, a la mezcla en tiempo real. Pueden ver resultados reales y no solo colocar una luz, volver mañana y ver cuál es el resultado. Pueden instintivamente iluminar un personaje, iluminar un ambiente. Y no hay soportes en C ni sacos de arena con los que lidiar. Todo el mundo está aprendiendo desde cero. Tenemos artistas que van desde los 20 hasta los 60 años, que provienen de una gran cantidad de experiencias diferentes. Pero todos están en el mismo campo de juego. Es genial verlos en nuestro chat de Unreal Engine en Slack, compartiendo cosas aleatorias que encuentran. Es muy, muy divertido.

Dentro de BRON Digital tenemos una gran comunidad de comunicación abierta. Hay una hora reservada al final de la semana para que todos muestren todo lo que han hecho, ya sea arte conceptual, modelado, rigging, herramientas, secuencias que mostramos, música, todo. Y todos participan, comparten y se asombran del trabajo de los demás, pero también comparten información sobre cómo lo hicieron.

Guía de la animación en tiempo real

Esas sesiones han sido increíblemente, increíblemente útiles a medida que avanzamos porque, eventualmente, todos esos empleados trabajarán juntos en un espectáculo u otro. Entonces, es importante que creemos ese sentido de comunidad, especialmente en este momento de la pandemia también.

Aaron: Además, la realidad es que nuestro primer programa fue la primera vez que lo hicimos. Hay una curva de aprendizaje. El segundo show es más eficiente y el tercero va a ser más. A medida que continuamos refinando los procesos y podemos, como dice Jason, compartir información entre los diferentes miembros del equipo, esa es la forma en que crecemos. Es la Universidad BRON. Ese es el objetivo.

¿Ve otras oportunidades más allá de la animación con esta canalización?

Aaron: Con una canalización tradicional, construiríamos, manipularíamos, animaríamos, pero solo tocaríamos las cosas que alguna vez íbamos a ver. No puedes tirar nada. Todo este mundo de Unreal Engine cambia las cosas por completo, porque no solo estás viendo lo que hay en la pantalla.

Tienes que ser consciente de todo, porque estás construyendo dentro de un motor de juego, por lo que es literalmente un 360 de tu entorno. Lo que viene con eso, es simplemente increíble. El director tiene que fijarse mucho no solo en lo que está directamente en esta pantalla, sino que también tenemos que proyectarlo en el metaverso, en el mundo en línea y en los juegos que estamos creando, porque cada uno de estos muestra, cada show que estamos haciendo en BRON Digital lo tiene todo.

El mundo en línea que estamos creando es cinemático y hermoso. Gracias al motor, podemos crear estos mundos increíbles que son vibrantes e interactivos. Todo lo que hacemos, cada dólar que gastamos aquí, lo reutilizamos en ese increíble mundo en línea, nuestro metaverso, el metaverso BRON con estas propiedades y luego con nuestros juegos.

Estrategia NFT

Tenemos una estrategia NFT muy ambiciosa y una estrategia de comercialización digital en torno a algunas de nuestras propiedades, en realidad tanto digitales como impresas. Nuestro objetivo es llegar al plato una y otra vez con este increíble trabajo. Todo el mundo quiere construir una franquicia, y cada franquicia comienza con los personajes que estás creando.

Todo el mundo tiene que enamorarse de esos personajes que están en pantalla, o no hay franquicia. Todo lo que estamos construyendo en este momento se está construyendo con el objetivo de crear franquicias. Creemos que nos estamos dando la mejor oportunidad de hacerlo gracias a lo que Unreal nos permite hacer y lo eficientes que pueden ser nuestros dólares.

Jason: En el aspecto técnico, pudimos hacer algo realmente emocionante con el entorno de Fables. Uno de nuestros artistas pudo armar una prueba de concepto funcional que transmitía píxeles desde el motor a un iPad de tercera generación, y pudo caminar por el entorno de Fables que vemos en nuestra serie de televisión con una aniquilación mínima. Y lo armó en tres días.

Guía de la animación en tiempo real

Podríamos portar eso porque los activos existen, porque las animaciones están ahí. Mientras animamos, también creamos bibliotecas de animación que inherentemente se conectan directamente al motor. Entonces es como si tuviéramos todas las herramientas disponibles. Siempre recordaré que estábamos sentados en nuestra oficina de Los Ángeles y les entregué a Aaron y Steven, nuestro CEO y COO, ese iPad. Y solo había un gran botón verde de Inicio. Lo presionaron y comenzaron a correr por el entorno con la misma iluminación que nuestros DP establecieron para esos entornos, con el tema musical sonando.

Ese es el verdadero sueño ahí mismo: una vez que termines de ver tu episodio y te encante el contenido que estás viendo, toma tu iPad y ve a explorar por tu cuenta ahora. Encuentra pequeños rincones y grietas. Planeamos continuar con futuras versiones de Unreal para ayudar a unir todo, aumentar la calidad y asegurarnos de que también estemos continuamente a la vanguardia de la tecnología.

Entrevista a Spire Animation Studios y Trouble

David Smith es Senior Vice President of Digital Production and Visual Effects, Cosku Turhan Real-time CG Supervisor y Rajesh Sharma VP of Engineering.

El equipo de Spire Animation Studios tiene una trayectoria impresionante, con trabajo en películas como Encanto; Spider-Man: En el Spider-Verse; y Cigüeñas. David Smith es el vicepresidente sénior de producción digital y efectos visuales de Spire, y aquí se le unen Cosku Turhan, supervisor de CG en tiempo real, y Rajesh Sharma, vicepresidente de ingeniería. Su trabajo es, como dice David, «romper tuberías para hacer las cosas».

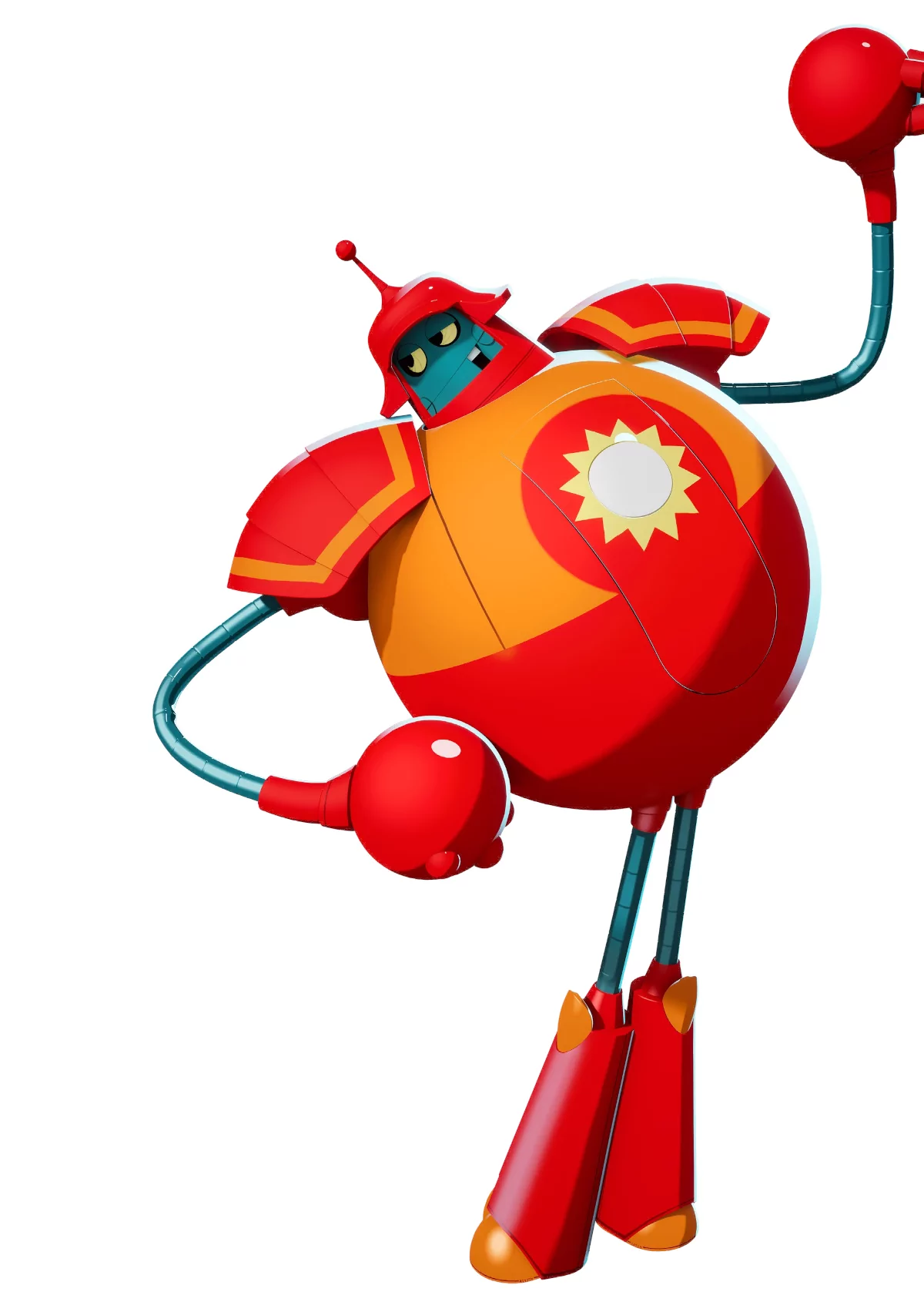

Los tres están trabajando en el actual proyecto en tiempo real de la compañía, la película Trouble. La historia sigue a Jax, un adolescente que ingresa a una dimensión paralela conocida como World of Trouble, donde emprende aventuras, hace amigos y planea un camino de regreso a casa.

¿Qué te hizo buscar canales de animación en tiempo real?

David: Queríamos alejarnos de los departamentos aislados que encuentras en los proyectos de animación tradicionales, donde un artista entra en una habitación y organiza las cosas. En cambio, queríamos tener un lugar donde pudiéramos ser un poco más espontáneos y comenzar a colaborar en Unreal Engine en el momento en que creábamos una historia.

Cualquier cosa que nos alejara de un artista que presentaba su trabajo, tomaba notas y volvía a sumergirse en un archivo independiente. Un flujo de trabajo en tiempo real tenía más sentido.

¿Cómo está cambiando el proceso en tiempo real la forma en que los artistas hacen su trabajo?

Cosku: Estamos en medio de un gran cambio de paradigma en este momento, porque Unreal Engine está abriendo muchos flujos de trabajo colaborativos. También está cambiando quién puede hacer qué y cuándo. Por ejemplo, nuestros modeladores también son escenógrafos y constructores de mundos.

Los artistas que nunca solían iluminar lo están intentando, y todo se debe a que ahora pueden ocurrir muchos procesos diferentes muy rápido dentro y alrededor del motor. Y creo que la gente está disfrutando eso, porque todos los que hemos estado contratando han dicho cosas como: «He estado haciendo lo mismo durante los últimos 10 años y quiero hacer las cosas de manera diferente». Pueden tener un mayor impacto en este nuevo paradigma usando muchos sombreros, y les gusta.

David: Darles a los artistas la oportunidad de usar más sombreros también se presta a equipos más pequeños y ágiles, que es un objetivo nuestro. Queremos reducir el tamaño de los equipos, para que podamos tener circuitos de comunicación más estrechos y asegurarnos de que todo se considere contextualmente, en lugar de por separado en departamentos inflados.

Guía de la animación en tiempo real

Estamos mirando la iluminación, por ejemplo, cuando estamos haciendo el diseño de los activos, porque la forma en que la luz golpea un entorno en particular es importante para la forma en que lo estamos construyendo. Y estamos descubriendo que la consideración se puede hacer temprano en el proceso en lugar de demasiado tarde, cuando tiene que volver atrás o simplemente vivir con eso porque no tiene tiempo para hacer el cambio.

Cosku: Hacerlo en tiempo real conduce a una fase de exploración realmente increíble durante el diseño y cuando estás ajustando las cámaras, porque tienes un set completo bajo tus manos. Y dentro de él están la iluminación y los elementos reales, todos los cuales están mucho más desarrollados de lo que tendrías en una etapa de diseño tradicional.

Esto permite este flujo de trabajo inteligente en el que puede colocar una cámara en un lugar donde antes no pensaría, porque no tenía los elementos frente a usted. Te permite explorar cosas muy, muy rápido y fácilmente. Y lo hace muy, muy divertido, también. Mucha gente está viendo esa chispa en la industria en este momento, y hay mucho entusiasmo a su alrededor.

Si las personas están usando muchos sombreros, ¿cómo se pone orden en el proceso?

Rajesh: Organizamos los equipos en grupos, lo cual es exclusivo de Spire.

David: Los llamamos pods porque los equipos de artistas en cada pod son multidisciplinarios. Entonces, en lugar de dividir las tareas en silos, por ejemplo, tener un diseñador de desarrollo haciendo lo suyo, un modelador haciendo lo suyo de forma independiente, y luego un encendedor haciendo la iluminación en un momento posterior, en Spire, todo el equipo está visualizando esas disciplinas juntas dentro de Unreal Engine. A medida que avanza el proceso de esculpido o modelado, el encendedor contribuye al mismo tiempo.

E incluso cuando estamos haciendo parte del modelado en Maya, por ejemplo, inmediatamente llevamos esa geometría a Unreal Engine, para que podamos tener esa interacción multidisciplinaria mientras pensamos en ello, mientras nos damos cuenta. el diseño general—en el mismo medio donde ejecutaremos la toma final.

Esto es excelente para los equipos de activos, por supuesto, pero también es útil para Layout. Cuando podemos mirar el diseño a través de una cámara prevista, podemos ver si está sirviendo a la historia a medida que los diferentes elementos se unen.

¿En qué estado se encuentran los activos cuando empiezas a colaborar?

David: Bastante duro. Una vez que tenemos un concepto en mente, intentamos simular algo en 3D lo antes posible en Unreal, para poder comenzar el proceso. A veces hay algunas texturas en él, pero en su mayoría comienza bastante bloqueado. Sin embargo, eso es suficiente para que comencemos y obtengamos los ritmos de la historia.

Lo siguiente que quiere el equipo es entrar en un volumen de captura de movimiento para un paso que llamamos Story Capture; todos nosotros estamos diciendo: «¡Vamos a dispararlo!» Y no tiene por qué ser complejo.

Hay muchas formas muy sencillas de capturar la historia en un entorno de producción virtual, y no necesitamos una gran captura de movimiento porque no tenemos la intención de usarla más adelante; haremos una animación estilizada de fotogramas clave con animadores de calidad para la interpretación final de la historia.

Guía de la animación en tiempo real

Obtienes una versión realmente genial del diseño de esta manera. Fomenta ese tipo de producción espontáneo que se siente orgánico y nos permite experimentar en el momento con mocap y un Live Link a la escena Unreal. A los actores también les encanta, porque pueden verse a sí mismos en contexto. Pueden darse la vuelta y ver cómo se ven como su personaje animado en el mundo estilizado en cualquier momento. Es realmente útil para ellos.

Otra ventaja es que una vez que haya realizado esos disparos iniciales, siempre tendrá los datos de movimiento. Si su edición inicial lo hace inclinarse hacia un ángulo diferente, aún puede usar los datos de rendimiento para refinar un diseño aproximado.

Una vez que tenemos una buena edición/diseño, dividimos las tomas y las enviamos al equipo de animación que actualmente trabaja en Maya. Utilizan la misma geometría de entorno que usábamos en Unreal, que exportamos como archivos USD. El equipo de animación anima las diferentes tomas y actuaciones, y luego las envía de regreso a Unreal para una mayor colaboración en el contexto para terminar la toma.

Guía de la animación en tiempo real

Una vez que las cosas comienzan a solidificarse un poco más, refinamos el resto de los detalles en cada toma, por ejemplo, agregando una iluminación clave muy específica en los personajes.

Luego renderizamos todo fuera de Unreal y obtenemos estas bellas imágenes. Hacemos un pase compuesto, un pase de post-proceso en NUKE con nuestros elementos principales y cualquier cosa que podamos romper. Esto nos da un poco de flexibilidad adicional, ya que no tenemos que resolver todo en el motor, al tiempo que nos brinda algunas herramientas adicionales que podemos usar para jugar con el aspecto de la imagen.

Cosku: A los directores también les encanta este proceso porque es muy inmediato. Las canalizaciones tradicionales no le dan el margen de maniobra para hacer cambios en el momento, o simplemente hacer que se sienten a su lado y cambien de luces o colores. Rajesh: A veces, cuando terminas el día, pierdes el contexto de la solicitud y por qué la hiciste en primer lugar. Cuando realiza cambios en paralelo, en tiempo real, puede ver de inmediato si una idea funciona o no.

¿Cuál fue el mayor desafío que enfrentó al implementar este flujo de trabajo?

David: Estamos en una posición única porque estamos comenzando con esta mentalidad, y todos los que estamos trayendo están a favor. Han visto los problemas con un flujo de trabajo departamentalizado y quieren hacer un cambio.

Pero incluso entonces, tienes que averiguarlo. La mayoría de nosotros no venimos de un entorno de juego. Afortunadamente, teníamos el entusiasmo de Cosku, que había pasado por algunos proyectos de AR y VR, e incluso había trabajado en animación lineal con Unreal Engine en el pasado.

La única barrera era la logística. Tuvimos que averiguar cómo usarlo y determinar lo que aún se necesitaba hacer de manera tradicional. Luego, a medida que aprende, comparte lo que sabe. Siempre estamos hablando de lo que hemos aprendido, en lo que estamos trabajando y lo que aún tenemos que resolver.

Guía de la animación en tiempo real

Creo que la tubería siempre estará evolucionando, ya que la tecnología está cambiando rápidamente. Todos están probando cosas diferentes, por lo que tratamos de aprender de ellos y de nuestras experiencias, tal como lo hicimos la primera vez que saltamos a las computadoras hace 20 o 30 años e intentamos hacerlo.

Rajesh: También veo otro desafío en el futuro. Lo probamos con un equipo pequeño, alrededor de 15 a 20 personas en ese momento, pero para hacer un largometraje de animación, habrá secuencias, cientos de tomas y cientos de personas distribuidas por todo el mundo. Gestionar ese trabajo y seguir colaborando sin pisarnos: ese va a ser el reto.

Cosku: Definitivamente escalabilidad, en términos de complejidad y tripulación. Porque si 100 personas están en la misma toma contra tres… por supuesto, eso lo hará mucho más complejo, pero lo resolveremos.

¿Pasar a un flujo de trabajo en tiempo real abre otras oportunidades para los estudios?

Cosku: Una de las principales razones por las que elegimos Unreal fue porque queremos que estas películas realmente vivan en el metaverso. No solo la distribución a una sala de cine o las plataformas de transmisión, sino también VR, AR y dispositivos móviles, para que pueda experimentar los personajes y sus entornos en múltiples plataformas.

Además, creo que muchos inversores también esperan ese mundo de metaverso en el que todos están interesados.

Esto nos permite ser ágiles con eso. Dado que todo está construido dentro de Unreal, podemos exportar estos mundos y personajes con bastante facilidad a diferentes plataformas y luego crear nuevas experiencias mucho más fácilmente. Es increíble tener un concentrador central que pueda atender todas estas diferentes formas de salida.

Entrevista con Sony Pictures Imageworks | en salas abovedadas sepultadas | doug extraño

Doug Oddy es productor sénior de efectos visuales. Doug Oddy llegó a Sony Pictures Imageworks (SPI) procedente de MPC, donde se desempeñó como productor de efectos visuales en varias películas como The Mummy, Suicide Squad, Guardians of the Galaxy y The Amazing Spider-Man 2. Se desempeñó como productor. en In Vaulted Halls Entombed, un episodio de la serie de Netflix Love, Death & Robots producido por SPI.

En Vaulted Halls Entombed, un episodio de la serie de Netflix Love, Death & Robots, se centra en un escuadrón de soldados que encuentran más de lo que esperaban mientras se aventuran bajo tierra tras el rastro de terroristas fugitivos. También fue el punto de partida para la primera incursión de SPI en la animación en tiempo real, un movimiento que los llevó a rehacer su tubería tradicional desde cero.

Cuéntenos sobre la construcción de la tubería para In Vaulted Halls Entombed

Vaulted Halls fue la primera vez que hicimos un proyecto en tiempo real usando un motor de juego en Sony. Creíamos en la tecnología: habíamos visto la calidad del trabajo que estaba saliendo tanto de personas como de empresas de todo el mundo, y sabíamos que era capaz de hacer lo que queríamos hacer.

También sabíamos que teníamos mucho que aprender y no queríamos entorpecer el proceso tratando de adaptarlo a nuestra canalización existente. En cambio, decidimos adoptar los conjuntos de herramientas en tiempo real y usarlos como se pretendía.

Tenemos una tubería extremadamente estable, robusta y confiable en Imageworks que ha estado en desarrollo durante más de 25 años. Como puede imaginar, los protocolos implementados requerirían una gran cantidad de tiempo y esfuerzo para integrar una nueva plataforma, especialmente una en la que pretendíamos confiar para el píxel final.

Configuraciones de red

Hay configuraciones de red, una gran base de código, nuestros equipos, nuestros sombreadores, la forma en que renderizamos. Cada pequeño detalle que hemos creado para mejorar el proceso de animación, cada herramienta que nuestros artistas emplean día a día, todas las herramientas patentadas o modificaciones a los DCC existentes que hemos escrito, literalmente nos alejamos de todo eso.

Nos construimos una caja de arena en la que podíamos usar Unreal Engine sin modificaciones. No queríamos perder tiempo tratando de hacer que Unreal Engine imitara nuestros flujos de trabajo, cuando estaba claro que los flujos de trabajo inherentes en tiempo real en el motor nos permitirían saltar al desarrollo creativo desde el principio. Queríamos centrarnos en crear grandes imágenes de inmediato y en crear una historia visual convincente que ayudara a impulsar la narrativa.

Teníamos un equipo de 40 a 45 personas trabajando internamente en la pieza, que tardó unos nueve meses en completarse, incluida la preparación, la preproducción, las capturas de rendimiento y la posproducción. Si considera que casi no teníamos experiencia con el tiempo real, el tiempo de respuesta es increíblemente rápido.

Fue un gran cambio en nuestro paradigma de producción, pero cuanto más intente impulsar los flujos de trabajo o las mentalidades tradicionales en un entorno en tiempo real, más luchará. Una vez que aceptamos las ventajas inherentes del tiempo real, el proyecto realmente despegó.

¿Cuáles fueron los pasos en la tubería?

Comenzamos con lo que llamamos la construcción «Nerf», que implicó construir la pieza de principio a fin utilizando piezas muy toscas. Esto nos dio los parámetros más básicos de lo que podría ser ese mundo. La construcción de mundos es un concepto que existe en los flujos de trabajo tradicionales, pero puede adoptar un enfoque muy medido y en capas cuando se trabaja en tiempo real.

Luego empezamos a bloquear la narrativa y el diálogo, los aspectos clave de la actuación. Normalmente harías esto en tomas individuales, mientras que aquí lo haces por secuencia e inmediatamente ves si el mundo que construiste se desarrolla.

Los guiones gráficos tradicionales siguen siendo muy efectivos, pero aquí en realidad creamos guiones gráficos directamente en el motor. Hicimos un pase de diseño aproximado con una versión de la pieza completa de 15 minutos que se sintió como una vista previa: debido a que las cámaras son más dinámicas, puede continuar agregándole forma con el tiempo. Al igual que una pintura, agrega capas con más detalle a medida que avanza.

Guía de la animación en tiempo real

Decidimos agregar algunas de nuestras propias capturas de actuación a la pieza, ya que queríamos proporcionar a los actores y al equipo de dobles la mayor cantidad de detalles posible antes de la filmación.

Nuestro equipo de animación usó trajes Xsens para avanzar en la película, agregando detalles y jugando con las ideas del director para los diferentes ritmos. Queríamos brindar a los artistas la mayor cantidad de detalles posible dado que actuarían en un escenario de sonido casi vacío, y podríamos brindarles la capacidad de verse a sí mismos en vivo en la pantalla, en la película, mientras actuaban.

La sesión de captura de movimiento fue increíble. Con toda la pieza en Unreal Engine, no solo podíamos mostrar a los artistas los personajes que estaban interpretando, sino también los entornos en los que se suponía que debían estar, en vivo en el escenario. Luego grabamos sus actuaciones con Take Recorder, lo que significaba que podíamos irnos al final de cada día con todas nuestras actuaciones disponibles para reproducir en nuestra escena de Unreal Engine.

Guía de la animación en tiempo real

En el transcurso de una semana, vimos la pieza transformarse de un borrador de animaciones a una pieza completamente desarrollada, completa con las actuaciones de los actores y las tomas seleccionadas por el director. Las capturas aún requerían limpieza y procesamiento facial, pero lo que podemos grabar en vivo en el motor es tremendo.

¿Qué tipo de trabajo hiciste fuera del motor?

Además del modelado y texturizado habituales, hicimos la animación de fotogramas clave para criaturas no humanas fuera del motor, las que no podíamos capturar.

Hicimos algunos de los efectos completamente en el motor y algunos en Houdini, simplemente porque necesitábamos dirigir el arte de ciertos aspectos con el director. Parte de la curva de aprendizaje también requería que aprendiéramos a adaptarnos a los flujos de trabajo y prácticas establecidos de nuestros clientes.

Utilizamos MetaHumans para crear tres de los seis personajes de la película. El equipo de 3Lateral nos ayudó a impulsar la tecnología para que los diseños se asemejaran mucho a la apariencia de nuestros actores, sin tener que pasarlos por una instalación de escaneo. La capacidad de marcar nuevos diseños de personajes por la mañana y luego animarlos por la tarde fue alucinante.

¿Cómo cambia el trabajo en tiempo real la forma en que abordas un proyecto?

Es un enfoque diferente porque no estás trabajando en tomas, estás construyendo un mundo. Una vez que se crea el mundo y se construye la animación, puede crear nuevas tomas y volver a visualizar la secuencia, la edición o la cinematografía, todo sin costo para su agenda. Siempre que se tarde en mover esa cámara o activo, ahí está su toma, renderizada en tiempo real.

Es bastante relajante trabajar y crear dentro de la edición actual de su película, a diferencia de las tomas individuales. Se pueden visualizar y completar o descartar grandes cambios sin esperar tres días para ver cómo funciona. Incluso nuestro proceso para tomar notas se ve afectado: cuando realiza los ajustes en vivo mientras trabaja, se pregunta para qué sirven las notas. Guardamos notas, pero son principalmente para documentación histórica, en caso de que queramos revisarlas más tarde.

Se dice que la belleza del teatro en vivo es que puedes ver una obra o actuación una y otra vez, y cada vez simplemente sentarte en un lugar diferente crea una experiencia completamente nueva. Trabajar en tiempo real tiene esa sensación. Puedes trabajar con calidad final y cambiar tu punto de vista, al instante y con solo un puñado de artistas. En ese momento, es como Navidad todos los días.

¿Qué ve para el futuro de las canalizaciones en tiempo real?

La naturaleza colaborativa de la comunidad en tiempo real se fortalece, especialmente con el enfoque abierto de Epic Games para compartir herramientas y hacer avanzar la tecnología para todos sus usuarios. Han creado una comunidad increíble. Existe la sensación de que recién comenzamos a ver los resultados de lo que esta comunidad de artistas puede hacer con estas herramientas. Es un momento emocionante.

Como probablemente ya se haya dado cuenta, el uso de una canalización en tiempo real requiere un cambio de mentalidad para aquellos que están acostumbrados a trabajar con un flujo de trabajo lineal. En este capítulo, discutiremos ese cambio y también veremos cómo una canalización en tiempo real afecta el proceso de producción general.

En el camino, conocerá a algunos de los creadores que han dado el salto y escuchará cómo lo hicieron y por qué.

Trabajar con una canalización en tiempo real

¿Qué significa producir con un flujo de trabajo en tiempo real? Estos son los principales aspectos de la tubería que conducen a este nuevo paradigma para la producción de animación.

Renderizado en tiempo real

Una diferencia importante entre las dos canalizaciones son los tiempos de renderizado. Debido a que la renderización puede ocurrir tan rápido como una fracción de segundo en una canalización en tiempo real, se elimina la larga espera entre presionar el botón Renderizar y ver los resultados. Al reducir el costo de renderizado, interrumpe efectivamente la canalización lineal y permite una iteración significativa en el diseño, el bloqueo, la iluminación, la animación, la composición, la ubicación de la cámara y otros aspectos de la producción.

Flujos de trabajo paralelos

Muchos usuarios de una canalización en tiempo real mencionan un flujo de trabajo paralelo como una de las grandes ventajas de una canalización en tiempo real. Los encendedores pueden funcionar además del modelado; la animación puede funcionar junto con los efectos. Debido a que todas las tomas se ensamblan en Unreal Engine, con herramientas de diseño, animación, iluminación, superficies y efectos fácilmente accesibles para todos los departamentos, ya no es necesario que un departamento espere a que otro termine y entregue las tomas para el siguiente paso.

Colaboración a través de una única plataforma

Unreal Engine proporciona un centro central para todos los activos, animación, iluminación, cámaras y efectos visuales, de modo que los departamentos puedan trabajar en paralelo en todas las secuencias, ahorrando tiempo en general y brindando más oportunidades para la narración colaborativa.

Todos los miembros de su equipo, desde directores hasta supervisores y artistas, pueden ver cómo se desarrolla el proyecto a medida que se agrega o edita cada pieza.

En una tubería tradicional, las notas se hacen por disparo. Con una canalización en tiempo real, puede trabajar en contexto en secuencias para probar variaciones y cambios. Una nota larga sobre un cambio en una toma puede ir desde «difícil de explicar» y potencialmente malinterpretada por un artista, hasta «Vamos a resolverlo mientras estamos juntos en la llamada». Tal flujo de trabajo mejora naturalmente la creatividad y la narración de su equipo, ya que los artistas pueden contribuir directamente al proceso en tiempo real.

Animación, estilo de acción en vivo

¿Qué pasaría si su proceso de animación pudiera ser más como una filmación de acción en vivo donde los directores pueden ser espontáneos, explorar su creatividad y descubrir accidentes felices en el set?

- El director y el DP pueden recorrer el escenario virtual para planificar las tomas, la iluminación y la acción.

- El Departamento de Arte puede experimentar con diferentes texturas, colores y materiales en conjunto con los encendedores del ambiente.

- El equipo de producción entrega «metraje» en lugar de tomas a Editorial, lo que les permite elaborar una mejor historia.

Al igual que en un set de acción en vivo, estas actividades pueden ocurrir a la vez, con varios miembros del equipo presentes y trabajando juntos. En lugar de que un departamento trabaje en un paso y lo transfiera al siguiente, los equipos trabajan en paralelo, en colaboración, para completar un proyecto.

Trabajar con ubicaciones, no con escenas

Mencionamos anteriormente que trabajar en una canalización en tiempo real se asemeja a un escenario de acción en vivo. Un ejemplo es la forma en que cada nivel en el motor es un escenario o ubicación donde puede filmar varias secuencias, de la misma manera que se pueden filmar varias escenas en una ubicación en una filmación de acción en vivo. Si bien, en teoría, podría hacer lo mismo en su aplicación DCC, Unreal Engine, al haber sido diseñado para el desarrollo de juegos de varios niveles, puede manejar entornos mucho más grandes y «más pesados» que la mayoría de las aplicaciones DCC.

BRON Digital ha aprovechado al máximo esta característica del motor al construir toda la ciudad de «Little Hamilton» en Unreal Engine. La ciudad incluye todos los escenarios de su serie animada Fables, y cada episodio tiene lugar en un lugar separado.

Haciendo el cambio

Algunos creativos llegan a la mesa en tiempo real con la idea de que usarán Unreal Engine para renderizar y nada más. ¿Por qué no llevar el entorno y los personajes completos al motor y renderizarlos allí? Si bien tal esquema podría tener algún mérito, se estaría perdiendo un mundo de beneficios si se limitara solo a eso.

Una de las razones por las que Unreal Engine puede reproducir tomas en tiempo real es que todas sus funciones integradas están diseñadas para optimizar los cálculos de renderizado. Los materiales, las luces, las cámaras y los aspectos de la escena que requieren cálculos con gran cantidad de memoria (trazado de rayos, activos instanciados, LOD, iluminación dinámica, sombras suaves, renderizado de pelo/pelo, multitudes, etc.) se configuran mejor utilizando el motor incorporado. -en herramientas, ya que estas han sido diseñadas para facilitar la reproducción en tiempo real.

El uso del sistema de secuencias de comandos visuales Blueprint abre otro mundo, donde puede escribir sus propias herramientas de producción para automatizar las tareas comunes de los artistas.

Canalizaciones en tiempo real

En una tubería en tiempo real, encontrará que la programación y la carga de recursos difieren significativamente del enfoque tradicional. Por ejemplo, es probable que sus mecheros y artistas de efectos visuales puedan comenzar a trabajar mucho antes de lo que solían hacerlo, superponiéndose con tareas que tradicionalmente se realizan al principio del proceso, como el diseño y el bloqueo. Espere que, especialmente en su primer proyecto, habrá algunos ajustes en el pensamiento en lo que respecta a la programación.

Con varias personas trabajando potencialmente en una toma o secuencia al mismo tiempo, el control de la fuente será importante. Muchos equipos de animación de Unreal Engine usan Perforce para realizar un seguimiento de las últimas actualizaciones y evitar que los artistas sobrescriban el trabajo de los demás.

También es probable que su proceso de revisión cambie dramáticamente, para mejor. Tener un centro central significa que todos pueden ver el progreso del proyecto y pueden sugerir cambios. Esto puede ser una bendición o una maldición, dependiendo de tu perspectiva. WildBrain Studio informa que durante la producción de LEGO Friends, después de que el equipo se dio cuenta de que todos podían contribuir, no era inusual que una sola sesión de revisión se convirtiera en una lucha libre de una hora de duración. Las sesiones se volvieron a controlar rápidamente al limitar quién podía asistir y por cuánto tiempo.

A pesar de estos desafíos, los equipos que han adoptado una tubería en tiempo real informan que hay muchos más beneficios que inconvenientes.

Entrevista a La Cabane Productions, Shards CGI | Mush-Mush y los Mushables

Perrine Gauthier es Productora y Fundadora, La Cabane Productions y Romain Trimaille es CEO y Head of CG, Shards CGI.

La Cabane es la productora con sede en Francia de Mush-Mush & the Mushables, una serie galardonada que retrata las aventuras cómicas de una comunidad de pequeños guardianes del bosque. Para la segunda temporada, La Cabane se asocia con Shards CGI, un estudio también con sede en Francia, para todo el trabajo de CG fuera del rigging y la animación. Después de usar un flujo de trabajo tradicional para la temporada 1, el equipo pasó a una canalización en tiempo real para la temporada 2.

¿Cómo se ve la canalización en este momento?

Perrine: Durante la primera temporada, habíamos utilizado un flujo de trabajo de Blender de extremo a extremo, pero ahora Unreal Engine está guiando el diseño, la iluminación, la revisión de tomas y la renderización del cuadro final.

Al usar Unreal Engine para el diseño, el equipo de CG puede anticipar cualquier problema con la iluminación y el renderizado durante la preproducción, mejorando la eficiencia y evitando la necesidad de volver a renderizar los fotogramas cuando surgen problemas artísticos o técnicos.

Los artistas también pueden mejorar la calidad de sus tomas al observar la posición y el papel de la luz antes de que comience la animación. El director, Joeri Christiaen, puede elegir ángulos de cámara que ya tengan en cuenta la dirección de la luz y las sombras, logrando la mejor fotografía para una escena y evitando posibles problemas relacionados con la luz y las sombras más adelante.

Guía de la animación en tiempo real

Romain: Los tiempos de renderizado drásticamente reducidos son otra gran ventaja. En la temporada 1, las imágenes finales llegaban a los 50 minutos por cuadro; apenas llegamos a los tres minutos por cuadro para la temporada 2, lo que significa que podemos dedicar mucho más tiempo a la calidad creativa e introducir más dispersión debajo de la superficie para agregar detalles.

También estamos obteniendo mucho valor de los sistemas de Unreal Engine, específicamente los que manejan materiales dinámicos, Blueprints y LOD. Estamos descubriendo que los flujos de trabajo son bastante fáciles y se prestan bien para cambios rápidos o tareas por lotes.

En términos de Blueprints, los estamos usando para modificar instantáneamente la calificación de múltiples activos a la vez. También usamos Python para automatizar las formas en que creamos, conformamos y exportamos activos y secuencias. Esperamos que esta API se extienda a más funciones en el futuro; es una herramienta poderosa.

Perrine: Esta nueva canalización también nos convenció de actualizar el contenido antiguo. Por ejemplo, nos inspiramos para volver a renderizar la secuencia de apertura de la temporada 1 en Unreal Engine para la temporada 2. Vimos la oportunidad de mejorar aún más la calidad sin dejar de preservar el aspecto del programa. Ahora el renderizado es más nítido, los colores son aún más vibrantes y el bosque está más vivo que nunca, gracias a las habilidades ambientales de Unreal.

¿Qué motivó el cambio a una tubería en tiempo real en La Cabane?

Perrine: Una de las principales razones es que queríamos reducir nuestra huella de carbono y el cambio ya está dando sus frutos. Desde que incorporamos Unreal Engine en nuestro flujo de trabajo de Mush-Mush & the Mushables, hemos visto una reducción del 90 % en el tiempo de renderizado entre las temporadas 1 y 2, y una reducción drástica en el consumo eléctrico, el volumen de la granja de renderizado y la necesidad de aire acondicionado; habitaciones. Solo para el tiempo de renderizado, estamos registrando 11.000 horas menos en una carga de trabajo de 14 300 fotogramas. Usamos Unreal Engine desde la etapa de diseño, lo que significa que podemos anticipar gran parte de la iluminación y evitar volver a renderizar más adelante.

¿Cuál es el valor de la animación en tiempo real? ¿Cómo lo ves progresar?

Romain: La principal ventaja, en esta etapa, es la capacidad de iterar muy rápidamente y, por supuesto, no tener que esperar horas para ver el renderizado. Esto nos da mucha flexibilidad y crea condiciones de trabajo más cómodas para nuestro equipo. Tenemos mucha curiosidad por ver los próximos desarrollos y ver si la animación en tiempo real se pondrá al día con las tecnologías más tradicionales, especialmente cuando se trata de elementos específicos como el vidrio, la vegetación y el cabello.

Perrine: Cuando dimos luz verde a la producción, Mush-Mush Season 2 fue una de las primeras series animadas de formato largo producidas con Unreal Engine. Esto está evolucionando claramente, ya que ahora se están trabajando en varios programas nuevos que utilizan esta tecnología, que es excelente para la industria de la animación. Las nuevas canalizaciones brindan nuevas perspectivas sobre proyectos y flujos de trabajo, y suceden cosas interesantes cuando sales de tu zona de confort.

Además, está el aspecto medioambiental. Aunque no es típico cambiar una canalización de CG entre temporadas, vimos esto como una gran oportunidad para implementar un flujo de trabajo que no solo fuera innovador, sino más ecológico. Existen claros beneficios artísticos, técnicos y de producción al elegir la animación en tiempo real, pero estas tecnologías también pueden desencadenar una mayor sostenibilidad en la industria.

Guía de la animación en tiempo real

La innovación ciertamente conlleva riesgos y costos adicionales, pero creemos que opciones como esta contribuirán a reducir la huella de carbono de nuestro sector. Por ejemplo, actualmente estamos trabajando con un consultor de sostenibilidad para evaluar cuidadosamente nuestras emisiones después del cambio y ver cómo nos ayudará a alcanzar los objetivos de nuestro plan de descarbonización. Sentimos que vamos en una buena dirección.

Entrevista a BRON Digital con Russ Smith, supervisor de efectos visuales y Alex Filipov, supervisor de animación

Russ ha trabajado para varios estudios, incluidos Walt Disney Feature Animation y DreamWorks Animation, en proyectos como Meet the Robinsons, Bolt, Abraham Lincoln Vampire Hunter y Night at the Museum. Alex fue animador senior en una variedad de proyectos como The Suicide Squad, Wonder Woman 1984, Men in Black: International y The Greatest Showman. Ambos se incorporaron a BRON Digital para trabajar en animación en tiempo real y VFX para la serie animada Fables.

¿Cómo ha sido el cambio de un canal de animación tradicional a uno en tiempo real?

Alex: Un día, lo “nuevo” toma un impulso hacia adelante y te arrastra con él. Me recuerda cuando empecé a pasar de la animación clásica al 3D. Originalmente, ni siquiera quería considerarlo. Ya podía dibujar lo que quisiera, así que no vi la necesidad. Pero luego apareció Tarzán y me convenció de que el 3D era algo que debería investigar, y tal vez había algo en todos esos beneficios de los que había estado escuchando.

Sentí lo mismo al trasladar nuestro último proyecto a Unreal. Puedes sentir que viene algo nuevo y vale la pena aprovecharlo. Y ya estamos arreglando algunos procesos heredados que solían hacernos enviar cosas al equipo de 3D. es refrescante

Russ: En este momento, creamos casi el 100 por ciento de nuestros entornos en Unreal Engine; use accesorios de una variedad de fuentes, incluido lo que podemos obtener gratis de Unreal Marketplace; y traiga los otros activos especialmente diseñados de nuestras aplicaciones DCC. Así que es una mezcla, no un reemplazo completo. Todavía tienes que hacer modelos, texturizarlos, manipularlos y animarlos. Pero lo que obtienes con Unreal Engine es un área increíblemente colaborativa para probar y finalizar ideas que es mucho más rápida y atractiva para todos.

¿Cómo se sienten los animadores con este flujo de trabajo?

Alex: Todos mis animadores están listos para saltar a Unreal, si aún no lo han hecho, especialmente los que acaban de salir de la escuela. Para ellos, no existe una larga historia del oleoducto tradicional. Lo que sea que les muestres, es su «primera vez». Son como, «Está bien, así es como lo hacemos».

Comenzar en tiempo real también les permite esquivar algunos de los vaivenes que la mayoría de los equipos tienen que soportar.

La comunicación es esencial, pero hay una gran diferencia entre enviar algo de vuelta a la canalización y finalizar las ediciones juntas en el momento sin cambiar de herramienta. Se necesita algo de coreografía y pensar en cómo hacerlo, pero las herramientas de Unreal nos ayudan a conectar al supervisor de VFX, al director y a los artistas en una discusión en vivo. Y eso reduce muchísimo los problemas de comunicación, lo cual es muy importante porque lo que hacemos es muy visual y, a veces, necesitas ver un cambio frente a ti para saber si es el correcto.

¿Estás trabajando con muchas escenas grandes con muchos elementos?

Alex: Lo estamos, y ese es uno de mis argumentos clave para sacar los procesos tradicionalmente laboriosos de nuestras aplicaciones DCC. Recuerdo esta escena realmente pesada que teníamos, que tenía entre 70 y 80 caracteres de resolución completa. En una aplicación DCC, tendrías que hacerlo en secciones. Esto es un problema porque las composiciones cambian todo el tiempo, la cámara cambia y, en última instancia, solo necesita ver todos los elementos en un solo lugar. Si intentáramos renderizar todo esto en una aplicación DCC, todavía estaríamos trabajando en esa toma nueve meses después.

Russ: Todos los trucos que habrías tenido que hacer… las importantes reducciones de polígonos, desactivar las pilas de deformadores y todo lo demás habría sido brutal, hasta el punto de que no estás viendo lo que esperas ver de todos modos. Pero con Unreal, usamos activos totalmente realizados y de resolución completa durante el proceso de iluminación y desarrollo de la apariencia, y hacemos juicios sobre la composición y el ritmo. Es la noche y el día.