SketchEdit manipula imágenes mediante trazos. La manipulación de imágenes basada en bocetos es una tarea interactiva de edición de imágenes para modificar una imagen en función de los bocetos de entrada de los usuarios.

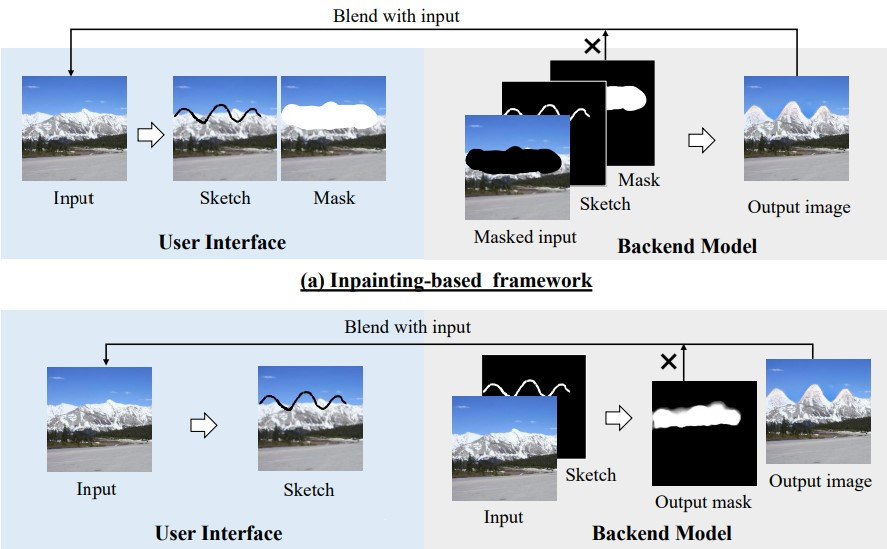

Los métodos existentes generalmente formulan esta tarea como un problema de pintado condicional, que requiere que los usuarios dibujen una máscara adicional que indique la región a modificar además de los bocetos.

Las regiones enmascaradas se consideran huecos y se rellenan con un modelo de pintura condicionado en el boceto. Con esta formulación, los datos de aprendizaje emparejados se pueden obtener fácilmente creando máscaras al azar y extrayendo bordes o contornos.

Aunque esta configuración simplifica la preparación de datos y el diseño del modelo, complica la interacción del usuario y descarta información útil en regiones enmascaradas. Con este fin, investigamos un nuevo paradigma de manipulación de imágenes basada en bocetos. Manipulación de imágenes locales sin máscara, que solo requiere bocetos de los usuarios y utiliza la imagen original completa.

Con un imagen y un trazo, podemos cambiar la imagen

Dada una imagen y un boceto, nuestro modelo predice automáticamente la región de modificación de destino; y la codifica en un vector de estilo independiente de la estructura. Luego, un generador sintetiza el nuevo contenido de la imagen basándose en el vector de estilo y el boceto.

La imagen manipulada se produce finalmente combinando la salida del generador en la región de modificación de la imagen original.

Nuestro modelo se puede entrenar de manera auto-supervisada; aprendiendo la reconstrucción de una región de la imagen a partir del vector de estilo y el boceto.

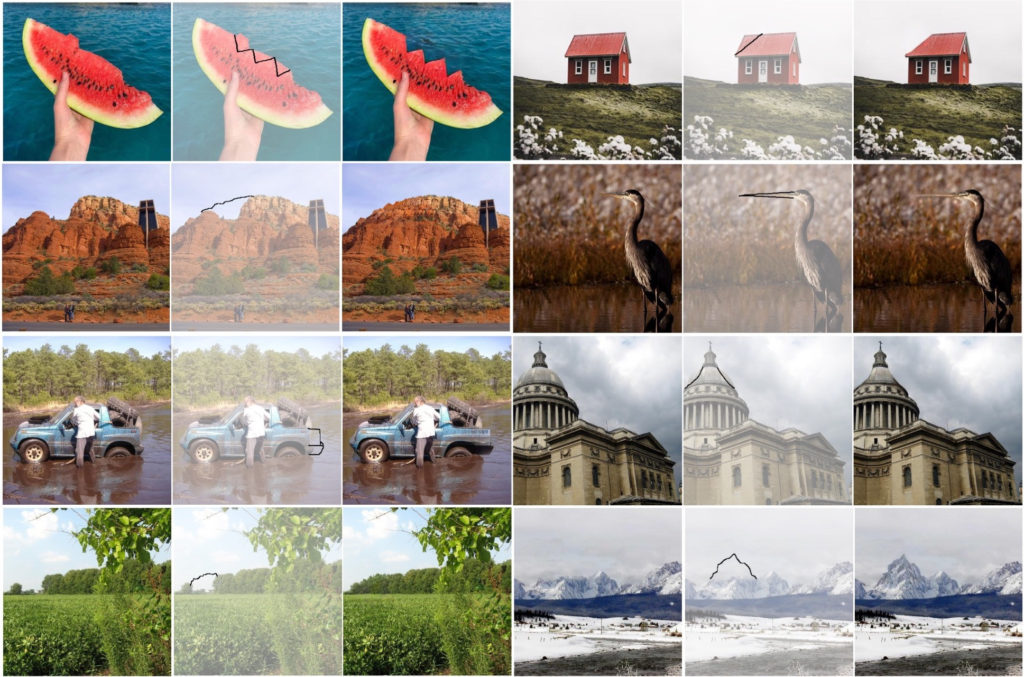

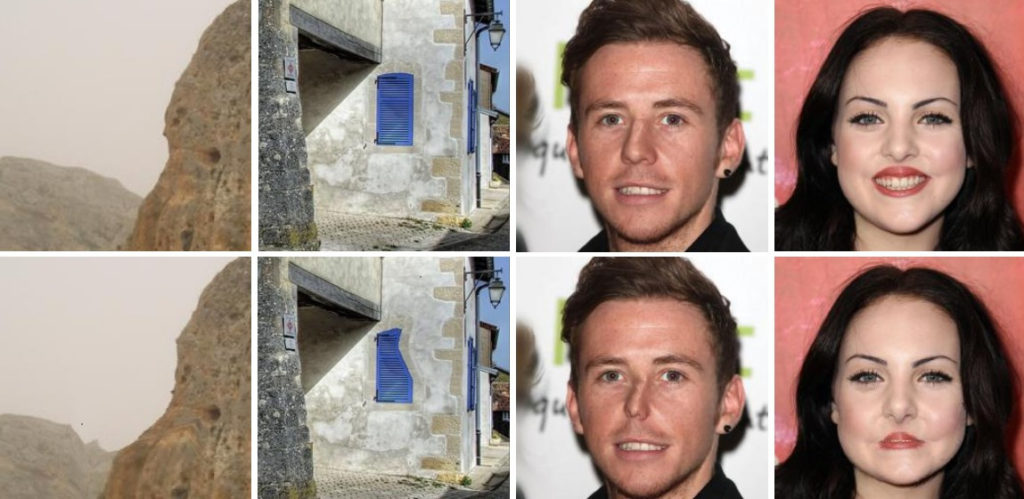

El método propuesto ofrece flujos de trabajo de usuario más simples e intuitivos; para la manipulación de imágenes basada en bocetos y proporciona mejores resultados que los enfoques anteriores.

Introducción al sistema SketchEdit

Recientemente, se han incrementado los esfuerzos y la demanda de crear herramientas de edición de fotografías interactivas en dispositivos con interfaces táctiles. Al ser expresivo y fácilmente editable, dibujar es una de las formas más sencillas en la que las personas ilustran sus ideas creativas e interactúan con las aplicaciones.

La edición de imágenes basada en bocetos es un tema de investigación emergente cuyo objetivo es construir modelos que puedan manipular estructuras holísticas o locales de una imagen de acuerdo con los bocetos dibujados por el usuario. Ha logrado un progreso significativo en los últimos años con avances en modelos generativos y de aprendizaje profundo, por ejemplo, GAN utilizado en varias aplicaciones como, GANverse3D.

Hay dos desafíos en la manipulación de imágenes basada en bocetos:

El boceto de entrada indica aproximadamente dónde modificar, pero se desconoce la región de modificación precisa y es difícil recopilar datos de pares de imágenes a gran escala (es decir, imágenes antes y después de la manipulación) para el aprendizaje. Los enfoques anteriores evitan estos obstáculos al convertir la manipulación de imágenes basada en bocetos en un problema de pintura condicional.

Los usuarios deben dibujar una máscara adicional para indicar las regiones a modificar además del boceto. Las regiones enmascaradas se consideran huecos y se rellenan con un modelo de pintura condicionado por el boceto.

Bajo este marco de pintado, los datos de aprendizaje emparejados se pueden obtener fácilmente generando máscaras aleatoriamente como en la imagen general en la pintura y extrayendo bordes/contornos en las regiones enmascaradas como bocetos sustitutos utilizando algoritmos de detección de bordes.

Luego, el problema puede resolverse entrenando un modelo de pintura para predecir la imagen original dada la imagen enmascarada, la máscara y el boceto como entrada. Esta inteligente formulación simplifica el diseño del modelo y la configuración del aprendizaje, y se ha explorado ampliamente en la literatura reciente.

SketchEdit pretende ahorrar tiempo y trabajo tedioso

Sin embargo, el marco de inpainting no es óptimo para la manipulación de imágenes basada en bocetos. Primero, aunque facilita el diseño y la capacitación del modelo, deja trabajo adicional a los usuarios y da como resultado una interfaz de usuario complicada.

Después de que los usuarios dibujen en una región de la imagen, deben volver a dibujar una máscara alrededor de la misma ubicación. Este procedimiento es tedioso y redundante.

Es posible que un usuario sin experiencia no pueda dibujar una buena máscara que cubra exactamente el área de modificación deseada, lo que dificulta que el modelo produzca resultados razonables.

En segundo lugar, con este marco, las regiones enmascaradas en una imagen de entrada deben eliminarse para que coincidan con la condición de aprendizaje del modelo de pintura.

Sin embargo, dado que el contenido original en una región de modificación normalmente está altamente correlacionado con el resultado deseado; ignorar esta información degradará la calidad de la imagen manipulada y conducirá a cambios no deseados en la región de modificación.

Con este fin, investigamos un nuevo paradigma de manipulación de imágenes basada en bocetos; que solo requiere entradas de boceto de los usuarios mientras se aprovecha toda la imagen original. Nuestro sistema proporciona una interfaz más sencilla y fácil de usar para la manipulación de imágenes: esbozar únicamente directamente sobre la imagen original.

SketchEdit ofrece resultados consistentes y acordes al entorno

Además, como el sistema toma la imagen completa como entrada, la información en la región de modificación se puede reservar. Dando como resultado una apariencia más consistente (por ejemplo, color, textura) con el contenido original en la región de modificación.

Para la edición local, se desea conservar la mayor parte del contenido de la imagen original y solo modificar la región de la imagen relevante que rodea la entrada del boceto. Por lo tanto, primero predecimos la región de modificación con un estimador de máscara y luego sintetizamos el contenido nuevo dentro con un generador. La imagen manipulada se produce mezclando la salida del generador con la imagen original usando la máscara predicha.

Para alentar la estructura del contenido sintetizado a seguir el boceto mientras solo se mantiene el estilo del contenido original. Codificamos la región de modificación de una imagen de entrada en un vector de estilo agnóstico de estructura con un codificador de estilo.

El sistema se puede entrenar de una manera auto-supervisada aprendiendo a reconstruir la región de modificación de destino basándose en los vectores de estilo y bocetos.

SketchEdit utiliza múltiples conjuntos de datos

Evaluamos nuestro método en múltiples conjuntos de datos, incluidos CelebAHQ, Places2 y conjuntos de datos recién construidos Sketch Face y SketchImg. Que contienen bocetos y máscaras dibujadas por los usuarios. Numerosos experimentos demuestran que el método propuesto supera a los enfoques más avanzados.

Para mostrar las ventajas de nuestro nuevo marco en términos de interacción con el usuario, incluimos una demostración interactiva en el material complementario. Nuestras contribuciones son las siguientes:

Investigación de un nuevo paradigma de manipulación de imágenes basada en bocetos: manipulación de imágenes locales sin máscaras; que solo requiere entradas parciales de bocetos por parte de los usuarios.

El primer sistema para la manipulación de imágenes locales basada en bocetos sin máscaras. Incluida la arquitectura de red, la adquisición de datos y la estrategia de capacitación.

Se realizan experimentos extensos en múltiples conjuntos de datos para demostrar la superioridad de nuestro enfoque sobre los métodos relacionados.

Más resultados, código y demostración interactiva disponibles en GitHub.